我国渔业产量巨大,经济价值显著,在国际贸易中占很大的比重。由于富含优质蛋白质、不饱和脂肪酸、维生素和矿物质,鱼类及其产品是我们饮食的重要组成部分[1]。如今,鱼类品质日益受到生产者和消费者的关注。鱼类品质由多种因素决定,这不仅包括生理和环境因素,捕捞后的处理与保存方式也对其有着显著影响[2]。同时鱼类产品的质量、新鲜度和真实性将决定其价值、价格和最佳食用日期[3]。

在全球食品供应链中,鱼类加工是一个至关重要的环节,面临着众多挑战,包括提高加工效率、确保产品质量和满足日益增长的市场需求等[2]。传统鱼类加工方法存在明显的局限性。例如,传统的鱼类分拣、切割和品质检测大多依赖人工操作,这不仅效率低下,而且结果的一致性和准确性难以保证。由于工作环境的恶劣以及收获高峰季节的高强度工作,加之疫情的流行,使得行业出现了明显的劳动力短缺问题,这意味着加快实现鱼类加工自动化迫在眉睫[4]。传统方法在处理复杂数据、实时监控和非破坏性检测方面的能力有限,这在当前快速发展的食品产业中显得尤为突出。除此之外,鱼类品质的下降不仅影响消费者的健康和满意度,也导致资源的极大浪费。鉴于此,需要开发快速且无损的现代技术来监测鱼类品质特性。如何有效地提升鱼类加工的自动化水平、提高生产效率、同时确保产品品质,成为行业亟需解决的关键问题。

在过去的三十年里,光学传感器和机器视觉系统的发明日新月异,它们变得越来越灵敏、强大和便宜。这一趋势为开发更快、更便宜和无创的鱼类加工和品质监测方法提供了可能。此外,机器学习(machine learning)也被证实能够加快鱼类加工生产效率,改善工作环境[5]。但传统的机器学习方法面对复杂鱼类加工仍存在不少难以克服的问题,如其依赖人工的特征设计、较差的鲁棒性。近年来,深度学习方法广泛应用于我们生活的众多领域,例如图像分类、文本翻译、语音识别、医疗应用和智能生产[6]。特别是深度学习中的卷积神经网络,在自动提取图像特征和处理图像分类问题上展现了巨大优势,极大地提升了鱼类加工自动化和非破坏性质量监测的能力。通过利用这些先进技术,我们可以克服传统鱼类加工方法的局限,实现更高效、更精准的加工和品质控制。

本综述旨在总结与探讨深度学习与机器视觉在鱼类加工与品质监测领域内的研究成果和应用现状。同时介绍了机器视觉与深度学习的技术原理和应用,讨论了其在当前研究中的挑战和未来的研究趋势。本文概述当前的加工技术与品质监测方法,为未来的研究趋势提供建议。

1 机器学习概述

传统的机器学习方法在分析原始自然数据方面存在局限,通常需要人工提取特征以辅助数据的解释。随着计算硬件能力和数据存储能力的提升,现可通过构建更为复杂的模型结构,增强机器学习算法的性能,实现对数据的深层次表示[7]。表示学习的核心是使机器能自动从原始数据中提取特征,从而更有效地执行检测、分类或回归任务。深度学习,特别是多层神经网络结构,优化了数据特征的表示学习过程[8]。

1.1 机器学习

机器学习作为人工智能的一类方法,通过分析训练数据集中的模式得到对新数据或趋势的预测。传统的机器学习方法侧重于从小规模数据集中手动提取特征,以平衡模型的泛化能力和可解释性,为处理有限样本问题提供了有效的框架。机器学习根据数据标签的存在与否,可细分为监督学习、无监督学习和强化学习。这些方法的理论基础深植于统计学,相关算法包括支持向量机、逻辑回归、K最近邻、K均值、贝叶斯网络、模糊C均值和决策树等[9]。近几十年来,许多研究者已将机器学习方法应用于鱼类加工与品质监测中,相关讨论将在后续章节进一步展开。

1.2 深度学习

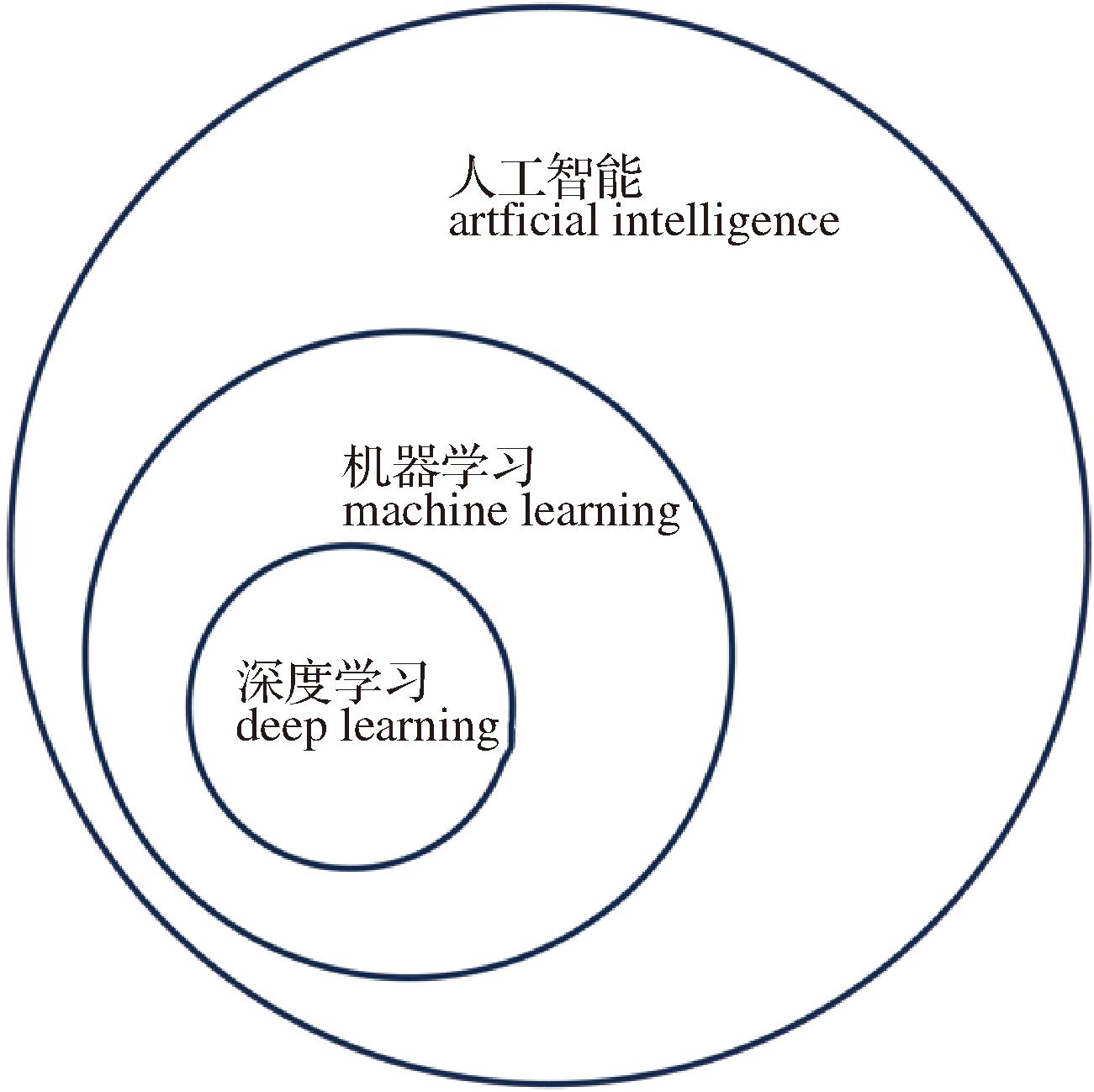

随着数据分析规模和复杂性的增长,传统机器学习方法在某些情况下显得力不从心。深度学习方法因其复杂的架构和高级的数据处理能力而得到了广泛的发展。深度学习模型一般包含输入层、输出层和多个隐藏层,通常适用于多种预测和分类任务,并且可以通过整合多个模型以提高性能[10]。深度学习在图像处理应用中的一个显著优势是其能够自动执行特征的分层提取。这一过程对于机器视觉系统在决策过程中的应用尤为关键,因为它允许模型直接从原始数据中学习到有意义的表示,而不依赖于需要多次迭代和手动调整的特征工程[11]。人工智能、机器学习和深度学习之间的关系如图1所示。本节简要介绍几种神经网络算法,并阐述它们的学习模型。

图1 人工智能、机器学习和深度学习之间的关系图

Fig.1 The relationship between artificial intelligence, machine learning and deep learning

1.2.1 人工神经网络(artificial neural network, ANN)

人工神经网络的设计原理基于生物神经网络,ANN模拟了人类大脑神经系统的信息处理机制,如模式识别和决策过程[12]。这些网络由大量互联节点(或称神经元)构成,每个节点代表一个激活函数,每两个节点间的连接代表一个权重。节点被排列在多个层中,包括输入层、隐藏层和输出层,具体架构如图2所示。输入层接受外部世界的输入并将其转换为图像的像素强度或其他可以量化的特征,输出层则用于获得概率预测结果。ANN常用于监督学习任务,如回归和分类问题。

图2 人工神经网络架构

Fig.2 Artificial neural network architecture

1.2.2 反向传播(back propagation, BP)

反向传播是一种训练多层前馈神经网络的算法,它通过误差的反向传播来更新网络权重。此方法依据微积分的链式法则,逆向从输出层到输入层遍历网络,计算权重梯度以优化网络性能[13]。反向传播算法要求每个输入值的预期输出已知,以计算损失函数的梯度。

1.2.3 卷积神经网络(convolutional neural network, CNN)

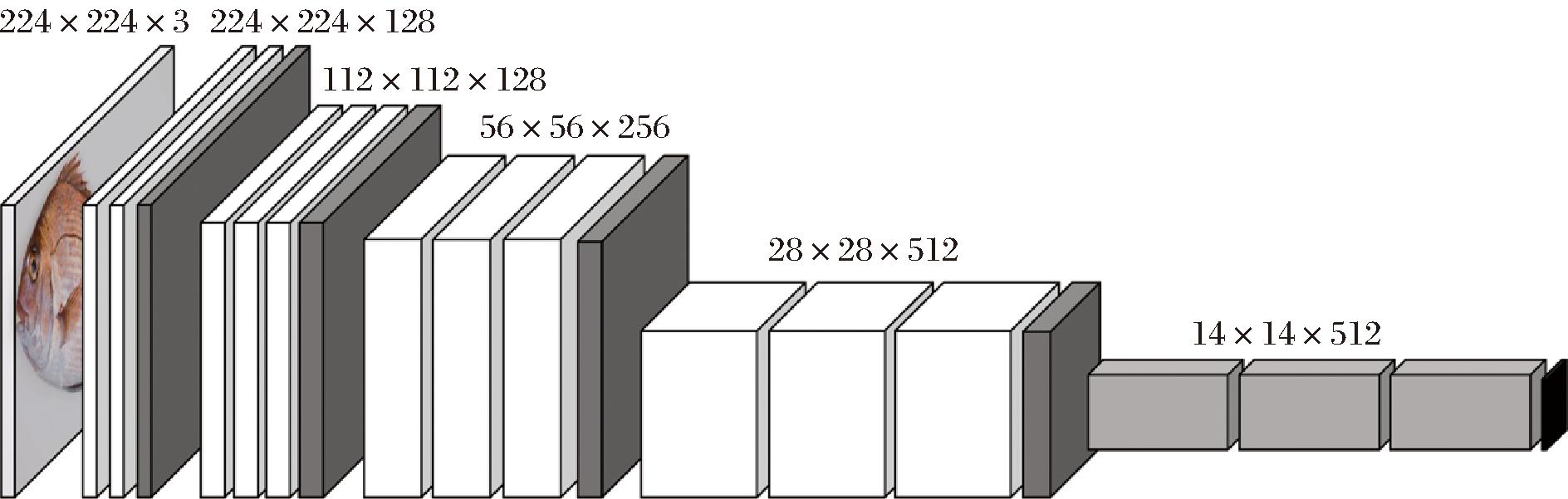

卷积神经网络是深度学习中用于图像分析和分类、推荐系统、图像和视频识别等应用的主要方法之一[14]。CNN通过应用线性代数概念,自动识别图像中的模式,极大地推进了物体识别的自动化。CNN由卷积层、池化层和全连接层组成,如图3所示。网络的深度增加,其对图像的理解也随之增加,最初的层次关注于基本特征,如边界和颜色,而更深层次的网络可识别更复杂的物体[15]。虽然CNN在自动检测特征方面具有优势,但也存在处理输入数据变化和空间不变性方面的限制[16]。此外,CNN通常需要多个图形处理单元(graphics processing unit,GPU)进行训练,否则训练过程可能会过于缓慢[17]。

其中白色为卷积层,深灰色为池化层,浅灰色为全连接层。

图3 一种典型的卷积神经网络VGG16的架构图

Fig.3 Architecture diagram of a typical CNN-VGG16

2 机器视觉系统

机器视觉系统(machine vision systems, MVS)利用电子图像捕获设备模仿人眼的视觉感知。这些系统主要由照明设备、图像获取设备、数字转换器或图像采集卡以及计算机构成,如图4所示。图像获取设备作为传感器,将光转换为可测量的电信号,随后这些信号经数字化转换为数字格式以供进一步处理[18]。机器视觉系统的典型工作流程包含图像采集和后续的图像处理2个主要步骤[19]。图像采集系统由光学传感器、图像采集板、照明系统等组件构成,旨在优化图像质量。图像处理则致力于从采集的图像中提取质量评估所需的关键信息。这些步骤涵盖了图像的分割、表示、解释及识别等多个操作,均可通过机器学习和深度学习算法执行。机器视觉系统已被证明在谷物、烘焙食品、肉类与鱼类、水果和蔬菜以及其他消费食品的加工与品质评估中,是一种优越的替代方案[20]。

图4 机器视觉系统示意图[21]

Fig.4 Machine vision system schematic[21]

2.1 图像获取

机器视觉系统能够通过照片、视频和其他三维(3D)技术实时获取图像。图像可以通过有线连接、互联网/以太网、射频识别或无线传感器网络传输至处理单元[22]。尽管二维(2D)可见光成像是MVS中最常见的形式,但其他成像技术如多光谱成像、高光谱成像、各种红外波段成像、立体表面成像和X射线成像等,也被广泛应用[12,18-19]。本节将介绍可用于鱼类加工和品质检测的多种图像采集方法。

2.1.1 传统成像

传统成像技术,作为机器视觉系统中的一个重要组成部分,主要依赖于电荷耦合器件(charge-coupled device, CCD)或互补金属氧化物半导体(complementary metal-oxide-semiconductor, CMOS)传感器来捕获图像[23]。这些传感器通过转换光信号为电信号,为机器视觉系统提供原始的视觉信息。CCD传感器因其高质量的图像采集和出色的光线适应性,长期以来被广泛应用于精密的成像需求中。而CMOS传感器则以其低功耗、快速处理能力和集成度高的优势,越来越多地用于工业和商业应用。无论是单色还是彩色,这些摄像头都能在不同光照条件下提供高分辨率的图像,这对于后续的图像处理和分析至关重要。在渔业领域,传统成像技术不仅被用于捕捉鱼类的外观特征,如大小、形状和颜色,还用于检测其外表质量,比如皮肤损伤或色素沉着[19]。除此之外,传统成像技术还可与比色传感器协同应用实现对食品品质的监测[24]。

2.1.2 高光谱成像

高光谱成像(hyperspectral imaging, HSI)是一种结合了光学光谱和数字成像的新兴技术[3]。该方法被称为化学成像,可提供有关感兴趣样品的丰富数据,获取空间和光谱信息[25]。除了可见光范围之外,还使用电磁波谱的近红外和紫外波长范围的逻辑支持了这一点。单个高光谱图像由称为超立方体的三维数据立方体组成,该立方体由两个空间成分和一个光谱成分组成,能够可视化样品生化成分的空间分布[26]。高光谱图像的获取有点扫描法、线扫描法、面扫描法和单次法等多种方法。前2种方法是空间扫描方法,而区域扫描方法是光谱扫描方法。单次方法是最快速的高光谱图像采集方法,但存在空间分辨率低和光谱范围窄的问题。根据照明源和探测器的位置,高光谱成像系统分为反射、透射和相互作用3种模式[27]。

2.1.3 近红外成像

近红外区域对应于电磁波谱中780 nm至2 500 nm的波长[28]。近红外光谱的原理是样品与近红外辐射的相互作用。入射到样品上的辐射可能会发生反射、透射或吸收。反射取决于样品的表面特征以及微观结构,而吸收则取决于化学成分[29]。每种化学成分都有相应的近红外吸收带,入射光源会导致特定的分子水平拉伸。对于详细的质量分析,某些化学成分的浓度梯度通常比平均浓度更有用。在传统的近红外光谱中,人们只能单调地逐点扫描整个样品,或者使用近红外区域的单次测量获得整个样品的平均特性。然而除了光谱信息之外,光谱成像还可以提供样品的空间信息[30]。

2.1.4 立体成像

立体成像系统是由一组可以测量物体到相机的距离(深度)的相机所构成。与传统的二维(2D)相机相比,立体系统增加了一维的深度,目的是改善其对现实世界的表现能力[31]。随着机器视觉的广泛使用,通过立体系统来收集环境的深度信息,然后进行物体识别和环境建模变得越来越普遍。立体相机原型用于捕获一对图像,可用于估计目标食物的尺寸[32]。在食品加工,尤其是在复杂的鱼类加工工序中,三维成像技术的应用极为关键。这类技术通过提供物体表面的深度信息,能够精确测量鱼类的体积、形状和表面特征,从而为自动化的分割、切割和分级等工序提供了重要数据支持,继而极大地提高加工的精度和效率[33]。

2.2 图像处理

图像处理旨在提升图像质量、解决图像失真问题、突出图像中的重要特征,并为特定任务准备适当的图像输入。图像中的噪声可能会降低图像质量,因此去噪过程致力于重建无噪声的图像以提高其清晰度,图像分辨率则直接影响对细节特征的识别能力[34]。解决低分辨率问题的直接方法是超分辨率,其从同一场景的一个或多个观察中恢复更高分辨率的图像[35]。深度学习,特别是深度卷积神经网络在图像超分辨率重建方面已显示出其创新潜力。使用深度卷积处理图像是深度学习领域用于超分辨率重建的开创性工作[36]。此外,样本量小和数据集分布不平衡可能会导致模型过度拟合,可以通过增加图像数量来解决这个问题。数据扩增方法包括旋转、翻转、平移、重新缩放和拉伸技术[37]。由于收集的图像通常具有不同的尺寸,为了便于后续数据处理并加快收敛过程,研究人员通常根据深度学习模型的要求将图像裁剪为特定像素[38]。随机裁剪正成为一种通用的计算机视觉数据处理方法。

图像处理方法有助于改善图像噪声、低分辨率、图像输入尺寸和小样本量数据的影响,但仍存在一些不足,包括测试阶段的优化方法、手动参数设置、针对单个降噪任务设置特定模型等[7]。随着架构变得越来越灵活,深度学习技术的兴起逐渐能够克服这些缺点。

3 鱼类加工

鱼类加工是全球价值数十亿美元的水产及其相关产业中的关键环节,涉及将捕获的生鲜鱼转化为市场上销售或进一步加工成其他鱼产品的过程[39]。由于鱼类产品价格高且消费者的需求各异,因此执行鱼类加工任务以确保最终产品的高质量至关重要。鱼类加工步骤通常在捕获后立即开始,包括分拣、击晕、放血、冷却、分级、去头(斩首)、去鳞、切片、剥皮、修剪和分割、切碎、副产品回收及包装等[40]。但上述这些步骤在传统鱼类加工流程中大多依赖熟练的技术工人,继而难以实现大批量的规模化和标准化。近几十年来,鱼类加工的自动化变得越来越普遍。当前已有多种机械设备被用于目前的加工环节中,每种设备只针对特定的加工阶段,如自动去头机和切片机[41]。这些设备需要能够处理不同大小的鱼类,这一挑战催生了应用机器视觉与机器学习为鱼类加工的精确识别系统。此外,机器视觉系统能够采集并保存每件产品的外观和质量信息,利于食品生产商了解优化其流程以及消费者的产地溯源。本节旨在介绍机器视觉和深度学习技术在各个加工阶段中的应用研究进展。

3.1 分类分拣

捕获的鱼类和水产品在品种和经济价值上有着显著的差异,因此对它们进行精确的识别、分类和管理至关重要。虽然已有多个鱼类识别管理系统被开发,但这些系统的识别能力、准确性和精度均有不足,不能完全满足对各种鱼类和相关水产品识别的需求。近年来,基于机器学习的视觉分拣系统的研究取得了显著进展。STORBECK等[42]利用置于传送带上方的相机测量鱼的多项几何特征,如宽度和长度,并结合ANN实现物种识别。NAKAI等[43]为鱼类分类进一步扩展了MVS的应用,使用网络摄像头和基于ANN模型的分拣系统,结合二维快速傅里叶变换(2DFFT)提取特征。RACHMATULLAH等[44]则采用CNN对低分辨率图像进行特征提取,在Fish CLEF 2015数据集上取得了99.7%的高分类准确率。ALLKEN等[45]在ImageNet分类数据集上进行预训练以获得模型参数,随后通过实际数据集优化CNN模型以对鱼类进行分类。MA等[38]则应用ResNet50网络对6个类别的鱼类图像进行分析,实验显示准确率达到97.19%。这些深度学习方法相比传统机器学习方法在计算效率和泛用性上具有显著优势,对于鱼类的自动分拣和加工具有巨大潜力。但其在渔获产品分类识别上的研究尚少,未来期望更多研究着力于此。

3.2 切割定位

鱼类屠宰过程涉及去除内脏、头部和尾部等不可食用部分,而往往因切割精度与切割操作效率的低下产生更多的废弃,最终导致损失高达70% [34]。在传统的鱼切割中人类扮演了重要的角色,因为切割过程主要是由工人使用刀具完成的[46]。而通过机器进行切割则需要对鱼体的精确定位,以达到目标的切割效果。机器视觉系统与深度学习方法天然适合这一操作流程。

通过机器学习,特别是基于深度学习的人工智能,在视觉识别任务(例如对象检测和分割)中表现出了卓越的性能。人工智能方法已用于鱼类识别,以提高自动化生产线的刀片切割效率[46]。它们可以进一步应用于鱼的去头、修剪和分割操作。在这一领域,GAMAGE等[47]的开创性研究将机器学习应用于切鱼任务中,他们利用CCD相机采集鱼头图像,并通过二维高斯平滑进行边缘增强以计算图像特征,后续使用多元回归算法(MLR)预测鱼头位置。HYUN等[48]通过激光扫描技术获得鱼类的三维形态,并结合3D信息实现了基于重量的切割定位,其误差控制在6%~8%。此外,LEE[49]进一步发展了一种结合3D图像处理和机器学习的方法,实现精确预测鱼类的切割点,使得预测误差降低至3%以下。XU等[50]运用CNN来检测鲑鱼肌肉间隙,以减少最终产品中不规则的空隙或不良的蕾丝状外观。这些研究表明,机器视觉与深度学习方法,一定程度上实现了对鱼体切割位置的精确识别与预测,并有望显著提高鱼类屠宰过程的效率和切割精度,从而有效减少蛋白质浪费并提升最终产品的质量。

3.3 重量估算

非侵入性地估计鱼的大小和重量对鱼类加工的经济与环保目标极为重要。自动化的测量过程能够降低成本并提供更一致的数据[51]。研究人员通常根据鱼的体形特征进行质量预测,利用图像处理方法提取尺寸、背部几何形状和身体面积来评估质量。BALABAN等[52]证实了使用机器视觉系统获取的视图面积与重量之间存在显著相关性。FERNANDES等[53]结合线性回归和CNN通过分析鱼体面积来预测体重,取得了较高的预测精度(其中![]() 0.96)。由于红外反射系统能够在暗环境中稳定采集鱼的图像,SABERIOON和

0.96)。由于红外反射系统能够在暗环境中稳定采集鱼的图像,SABERIOON和![]() 则利用近红外光采集图像,并结合随机森林(random forest, RF)算法和SVM模型来预测鱼的几何特征,克服了光照条件的限制并准确快速地估算了鲱鱼的重量。ZHANG等[55]提出了一种主成分分析-累积变异函数(PCA-CF)和ANN相结合的鱼类质量估算方法,其估算结果误差为估算结果误差为(其中

则利用近红外光采集图像,并结合随机森林(random forest, RF)算法和SVM模型来预测鱼的几何特征,克服了光照条件的限制并准确快速地估算了鲱鱼的重量。ZHANG等[55]提出了一种主成分分析-累积变异函数(PCA-CF)和ANN相结合的鱼类质量估算方法,其估算结果误差为估算结果误差为(其中![]() 通过采用先进的机器视觉技术和深度学习算法,研究人员能够非侵入性地准确估计鱼的大小和重量。这些技术的应用不仅提高了测量的精确性和效率,还将为鱼类加工行业带来经济和环保上的显著益处。

通过采用先进的机器视觉技术和深度学习算法,研究人员能够非侵入性地准确估计鱼的大小和重量。这些技术的应用不仅提高了测量的精确性和效率,还将为鱼类加工行业带来经济和环保上的显著益处。

4 品质监测

在不当的处理、运输或贮存条件下,鱼类很容易发生理化性质的变化和微生物引起的腐败变质,导致鱼类及其产品的品质恶化。因此,维持和监测鱼类的安全和质量非常重要[2]。FREITAS等[56]指出消费者主要关注营养价值、新鲜度、食用品质以及尺寸、品种和类型等物理品质,而变质食品会为因感官特性变化而使得消费者无法接受。本文着重于基本的鱼类品质指标,如新鲜度和腐败指标,这些是评估鱼类品质的关键因素。

传统的品质监测手段通常需要采集鱼肉组织,通过分析其理化特性进行判断,这些操作流程大多耗时耗力且对鱼肉具有破坏性。近年来,研究人员已经探索了各种成像和光谱技术在食品质量控制中的应用潜力[57]。成像技术主要关注电磁波谱的波长,其主要目标是根据视觉属性来评估鱼的品质。光谱方法大多具有破坏性,但准确性有所提升。目前正在使用改进的技术配置来应用多种比色方法和分析技术。除了这些仪器方法,将传感元件集成到食品包装中也能为消费者提供关于鱼类品质的直观信息[2]。机器视觉系统在无损快捷地评估鱼类新鲜度和质量方面展现出有效性,本章将重点介绍不同图像获取方式的机器视觉技术在鱼类品质检测中的最新研究进展。

4.1 传统成像

传统成像的机器视觉技术,通过计算机分析真实场景下的图像,已成为食品质量监控领域的重要工具[58]。特别在鱼类品质评估方面,这项技术凭借其自动化、非破坏性和成本效益高的特点显示出巨大的潜力[1]。过去基于机器学习方法的评估方法主要依赖于鱼体的生理特征,如瞳孔和鱼鳃,来评估鱼类的新鲜度和健康状态。这种方法提供了快速、准确的评估结果,同时避免了对样品的物理损害[59]。然而其在处理复杂图像数据和适应多变环境条件的能力有限,限制了精准评估的潜力。为了克服这些局限,深度学习的应用,特别是CNN的引入,为提升识别和分类精度提供了有效途径[9]。

TAPPI等[59]通过计算机视觉特征(如表皮色素沉着丧失、鳃黏液程度和眼睛凹度等指数)与已有的TMA含量和QIM评分方法相关联,成功确定了红鲻鱼的新鲜度评估方法,研究中发现表皮色素沉着损失和眼睛凹度指数对于评估红鲻鱼新鲜度极为敏感。ISAAC等[60]开发了一种基于鳃颜色的计算机视觉和图像处理技术,用以确定鱼的质量和新鲜度。SHI等[61]开发了一种基于罗非鱼瞳孔和鳃颜色变化的机器视觉系统,用于测定冷藏期间的TVB-N、TBA和TVC。HUANG等[62]结合计算机视觉、近红外光谱和数据融合技术,评估了鲽鱼的新鲜度。此外,TAHERI-GARAVAND等[63]提出了一种基于深度卷积网络的新鲜度检测方法,采用VGG16网络实现了基于新鲜度的鲤鱼图像分类。机器视觉技术结合深度学习模型,已经在评估鱼类新鲜度方面研究显示了一定的有效性和敏感性。但由于其样本量过小和适应范围有限,未来研究应着眼于扩大数据集、增强算法的泛化能力,以提高模型的实用性和鲁棒性。

4.2 高光谱成像

机器视觉系统和光学光谱学已被证明是快速、非侵入性地评估鱼和鱼产品质量的优秀工具。然而,这两种方法都有一定的局限性。机器视觉系统通常在可见波长下运行,这使得它无法区分具有相似颜色的物体,无法预测不可见的缺陷和化学成分。另一方面,光谱学不提供有关组分的形态、结构和空间分布的信息[64]。高光谱成像技术最初在遥感应用中引入,现已在食品加工领域,特别是在肉类、鱼类和家禽产品的质量评估中广泛应用[65]。

CHENG等[66]通过高光谱成像估算石斑鱼中总挥发性盐基氮(TVB-N)含量的方法检测其新鲜度,使用偏最小二乘回归和最小二乘支持向量机将数据与化学成分值相关联,并生成TVB-N分布图以评估鱼的品质。WANG等[67]利用前馈神经网络(FNN)与高光谱成像技术监测大黄鱼在低温贮藏期间的颜色变化,以此评估其品质变化。KHOSHNOUDI-NIA等[68]证明了结合多光谱成像技术和BP-ANN模型能有效预测虹鳟鱼鱼片中的TVB-N含量。MOOSAVI-NASAB等[69]则将深度学习算法LDNN应用于高光谱成像,以合理的精度(其中![]() 预测虹鳟鱼鱼片中的TVB-N含量。尽管高光谱成像技术在检测鱼肉腐败方面展现出其独特优势,但其数据处理仍是一个挑战,所需的计算技能和资源一直是限制其在鱼类加工行业广泛应用的主要因素。

预测虹鳟鱼鱼片中的TVB-N含量。尽管高光谱成像技术在检测鱼肉腐败方面展现出其独特优势,但其数据处理仍是一个挑战,所需的计算技能和资源一直是限制其在鱼类加工行业广泛应用的主要因素。

4.3 近红外成像

近红外成像技术在鱼类品质评估中的应用非常多样化,特别是在检测鱼肌肉中的蛋白质、水分、脂肪和碳水化合物等关键成分方面[1]。例如,鱼肌肉中蛋白质的氨基变性与2 080~2 220 nm以及1 560~1 670 nm波长的光谱相关,而水分和脂肪含量则与羧基结构以及亚甲基等基团相关[30]。通过收集反射或透射光谱并进行多变量数据分析,近红外光谱技术能有效评估鱼类的品质,过去不少研究已证明这一方法的可行性。DING等[70]结合近红外反射光谱和化学计量分析预测冷藏条件下鲢鱼的K值。PAULINE等[71]研究采用近红外光谱与混合变量选择相结合的策略,结合ANN实现快速无损的鲭鱼组胺含量评估。

随着近红外成像技术的成熟与便携化,近年来研究人员日益将其应用于鱼类的品质监测研究之中。SIVERTSEN等[72]使用手持式探针和成像光谱仪确定冰冻鳕鱼的新鲜度,能够区分解冻鱼片与新鲜鱼片。ZOTTE等[73]评估了近红外成像在评估生和熟虹鳟鱼片质量方面的潜力。HUANG等[74]利用计算机视觉和近红外光谱技术捕获鳊鱼在贮藏过程中的感官和结构变化信息,并采用PCA与BP-ANN建立新鲜度预测模型,分别在训练集和预测集上实现94.17%和90.00%的准确率。红外光谱和成像技术的核心在于构建准确的数学模型,以便有效评估水产品的质量。未来的研究方向应着重于降低参考方法误差,同时采用更广泛的参考值范围和更大的样本集,以开发出更精确、更高效的分析算法。

4.4 比色传感器

比色传感器是一种利用色彩变化来监测鱼类品质的有效工具,这些传感器依据Lambert-Beer定律,能够捕捉介质浓度变化导致的光传输吸收差异。在鱼类品质评估中,比色传感器通过检测特定腐败标志物与解决方案的反应,测量颜色强度变化[3]。HUANG等[74]和MORSY等[75]的研究表明,比色传感器能够检测鱼腐败过程中生成的挥发性化合物,并且与传统方法相比,能更早地检测到腐败。同时这些传感器的颜色变化可以由机器视觉系统采集,继而通过计算机软件进一步处理以实现准确的定量分析。

DOMINGUEZ-ARAGON等[76]开发了一种基于聚(邻苯二胺-苯胺)的比色法,该方法通过监测共聚物颜色的变化来评估罗非鱼片在10 ℃下储存期间的微生物生长,特别是与TVB-N值相关的假单胞菌属。GUO等[77]将交叉反应比色条形码与深度卷积神经网络(deep convolutional neural network, DCNN)相结合,构建了一个简单智能手机 APP 界面平台实现实时快速无损地监测鱼肉TVB-N含量。此外,MA等[78]设计了一个可扩展的鲑鱼新鲜度预测系统,该系统由染料与溶胶-凝胶官能化纸张传感器组成的光学可变比色传感器和基于图像的DCNN新鲜度估计系统两部分组成。比色传感器通过检测介质中特定腐败标志物的颜色变化,配合机器视觉与深度学习算法,已被证明是一种可行有效监测鱼类品质的工具。其低成本、高灵敏度、以及能够与智能设备如智能手机应用程序集成等特性,显著增强了早期腐败检测的实时性和无损性,为鱼类品质监测提供了创新解决方案。

5 结论

本文探讨了深度学习与机器视觉技术在鱼类加工及品质监测中的应用。鱼类作为全球食品市场的一个重要部分,其加工效率和产品质量对于满足不断增长的消费需求至关重要。加之渔业行业劳动力紧缺问题的日益凸显,近年来加速产业自动化的需求进一步显现。机器视觉被证明在提高鱼类加工自动化和非破坏性质量监测方面具有重要价值,特别是在分类分拣、切割定位和重量估算等特定任务中。尽管机器学习技术已被成功应用于多个单一的加工工艺,但其处理复杂图像数据和适应多变环境的能力存在局限。这些局限性加剧了对深度学习技术研究的需求,后者在自动提取有意义特征方面显示了潜在的巨大优势。基于现有的文献,我们发现有关利用单一视觉系统解决鱼类加工和品质监测多个问题的综合系统的研究仍然缺乏。这种整合性系统可以为行业带来革命性的变化,提供从原材料评估到最终产品质量控制的全面解决方案,但目前此类研究仍处于起步阶段。

我们认为未来研究的重点应是开发能够整合多个加工和监测任务的全面系统,这不仅可以提高效率和减少成本,还可以通过实时监测确保产品质量。这需要跨学科的合作,结合食品科学、计算机视觉、机器学习和深度学习的专家知识。因此,通过促进这些领域之间的创新合作,我们可以期待在鱼类加工和品质监测方面实现更多的自动化以及智能化,从而更好地满足全球市场的需求。

[1] WU L L, PU H B, SUN D W. Novel techniques for evaluating freshness quality attributes of fish: A review of recent developments[J]. Trends in Food Science &Technology, 2019, 83:259-273.

[2] NIMBKAR S, AUDDY M, MANOJ I, et al. Novel techniques for quality evaluation of fish: A review[J]. Food Reviews International, 2023, 39(1):639-662.

[3] SUN D W. Hyperspectral imaging for food quality analysis and control[M]. London: Academic, 2010.

[4] MINAHAL Q, MUNIR S, KOMAL W, et al. Global impact of covid-19 on aquaculture and fisheries: A review[J]. International Journal of Fisheries and Aquatic Studies, 2020, 8(6): 42-48.

[5] SABERIOON M, GHOLIZADEH A, CISAR P, et al. Application of machine vision systems in aquaculture with emphasis on fish: State-of-the-art and key issues[J]. Reviews in Aquaculture, 2017, 9(4):369-387.

[6] CIOFFI R, TRAVAGLIONI M, PISCITELLI G, et al. Artificial intelligence and machine learning applications in smart production: Progress, trends, and directions[J]. Sustainability, 2020, 12(2):492.

[7] SCHMIDHUBER J. Deep learning in neural networks: An overview[J]. Neural Networks, 2015, 61:85-117.

[8] ZHOU L, ZHANG C, LIU F, et al. Application of deep learning in food: A review[J]. Comprehensive Reviews in Food Science and Food Safety, 2019, 18(6):1793-1811.

[9] KHAN M I H, SABLANI S S, NAYAK R, et al. Machine learning-based modeling in food processing applications: State of the art[J]. Comprehensive Reviews in Food Science and Food Safety, 2022, 21(2):1409-1438.

[10] ZHU L L, SPACHOS P, PENSINI E, et al. Deep learning and machine vision for food processing: A survey[J]. Current Research in Food Science, 2021, 4:233-249.

[11] LI D L, DU L. Recent advances of deep learning algorithms for aquacultural machine vision systems with emphasis on fish[J]. Artificial Intelligence Review, 2022, 55(5):4077-4116.

[12] ABIODUN O I, JANTAN A, OMOLARA A E, et al. Comprehensive review of artificial neural network applications to pattern recognition[J]. IEEE Access, 2019, 7:158820-158846.

[13] GU J X, WANG Z H, KUEN J, et al. Recent advances in convolutional neural networks[J]. Pattern Recognition, 2018, 77:354-377.

[14] WECHSLER H. Neural Networks for Perception[M]. Boston: Academic Press, 1992.

[15] ZEILER M D, FERGUS R. Visualizing and understanding convolutional networks[M]. Lecture Notes in Computer Science. Cham: Springer International Publishing, 2014:818-833.

[16] WANG K, ZHANG L, TANG W J, et al. Asymmetric guerbet reaction to access chiral alcohols[J]. Angewandte Chemie International Edition, 2020, 59(28):11408-11415.

[17] TAN M, LE Q V. EfficientNet: rethinking model scaling for convolutional neural networks[C]. Proceedings of the 36th International Conference on Machine Learning, PMLR, 2019: 6105-6114.

[18] HONG H M, YANG X L, YOU Z H, et al. Visual quality detection of aquatic products using machine vision[J]. Aquacultural Engineering, 2014, 63:62-71.

[19] BROSNAN T, SUN D W. Improving quality inspection of food products by computer vision—A review[J]. Journal of Food Engineering, 2004, 61(1):3-16.

[20] VITHU P, MOSES J A. Machine vision system for food grain quality evaluation: A review[J]. Trends in Food Science &Technology, 2016, 56:13-20.

[21] SU Y, ZHANG M, MUJUMDAR A S. Recent developments in smart drying technology[J]. Drying Technology, 2015, 33(3):260-276.

[22] BOUZEMBRAK Y, KLÜCHE M, GAVAI A, et al. Internet of things in food safety: Literature review and a bibliometric analysis[J]. Trends in Food Science &Technology, 2019, 94:54-64.

[23] SHORTIS M, HARVEY E, SEAGER J. A review of the status and trends in underwater videometric measurement[C]. Videometrics IX, San Jose, CA, United States: SPIE Conference, 2007, 6491: 1-26.

[24] JIA X X, MA P H, TARWA K, et al. Machine vision-based colorimetric sensor systems for food applications[J]. Journal of Agriculture and Food Research, 2023, 11:100503.

[25] CHENG J H, SUN D W. Hyperspectral imaging as an effective tool for quality analysis and control of fish and other seafoods: Current research and potential applications[J]. Trends in Food Science &Technology, 2014, 37(2):78-91.

[26] LIU D, ZENG X N, SUN D W. Recent developments and applications of hyperspectral imaging for quality evaluation of agricultural products: A review[J]. Critical Reviews in Food Science and Nutrition, 2015, 55(12):1744-1757.

[27] GOWEN A A, O’DONNELL C P, CULLEN P J, et al. Hyperspectral imaging-an emerging process analytical tool for food quality and safety control[J]. Trends in Food Science &Technology, 2007, 18(12):590-598.

[28] LOHUMI S, LEE S, LEE H, et al. A review of vibrational spectroscopic techniques for the detection of food authenticity and adulteration[J]. Trends in Food Science &Technology, 2015, 46(1):85-98.

[29] LIU D, ZENG X A, SUN D W. NIR spectroscopy and imaging techniques for evaluation of fish quality—A review[J]. Applied Spectroscopy Reviews, 2013, 48(8):609-628.

[30] ALAMPRESE C, CASIRAGHI E. Application of FT-NIR and FT-IR spectroscopy to fish fillet authentication[J]. LWT-Food Science and Technology, 2015, 63(1):720-725.

[31] KANG S B, WEBB J A, ZITNICK C L, et al. A multibaseline stereo system with active illumination and real-time image acquisition[C].Proceedings of IEEE International Conference on Computer Vision. Newyork: IEEE, 1995:88-93.

[32] SUBHI M A, MD ALI S H, ISMAIL A G, et al. Food volume estimation based on stereo image analysis[J]. IEEE Instrumentation &Measurement Magazine, 2018, 21(6):36-43.

[33] LIU W B, LYU J Q, WU D, et al. Cutting techniques in the fish industry: A critical review[J]. Foods, 2022, 11(20):3206.

[34] WANG Z F, MIAO Z J, JONATHAN WU Q M, et al. Low-resolution face recognition: A review[J]. The Visual Computer, 2014, 30(4):359-386.

[35] YANG J G, GUO Y H, WANG X L. Feature extraction of hyperspectral images based on deep Boltzmann machine[J]. IEEE Geoscience and Remote Sensing Letters, 2020, 17(6):1077-1081.

[36] DONG C, LOY C C, HE K M, et al. Image super-resolution using deep convolutional networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2016, 38(2):295-307.

[37] WANG M F, LIU M Y, ZHANG F H, et al. Fast classification and detection of fish images with YOLOv2[C]. 2018 OCEANS-MTS/IEEE Kobe Techno-Oceans (OTO).Newyork: IEEE, 2018:1-4.

[38] MA Y X, ZHANG P F, TANG Y H. Research on fish image classification based on transfer learning and convolutional neural network model[C]. 2018 14th International Conference on Natural Computation, Fuzzy Systems and Knowledge Discovery (ICNC-FSKD). Newyork: IEEE, 2018:850-855.

[39] ADEYEYE S A O. Traditional fish processing in Nigeria: A critical review[J]. Nutrition &Food Science, 2016, 46(3):321-335.

[40] BULJO J O, GJERSTAD T B. Robotics and Automation in Seafood Processing[M]. Robotics and Automation in the Food Industry. Amsterdam: Elsevier, 2013:354-384.

[41] EINARSD TTIR H, GU

TTIR H, GU MUNDSSON B,

MUNDSSON B,  MARSSON V. Automation in the fish industry[J]. Animal Frontiers, 2022, 12(2):32-39.

MARSSON V. Automation in the fish industry[J]. Animal Frontiers, 2022, 12(2):32-39.

[42] STORBECK F, DAAN B. Fish species recognition using computer vision and a neural network[J]. Fisheries Research, 2001, 51(1):11-15.

[43] NAKAI M, SATOH H, TAKEDA F. Proposal of an automatic fish sorting system by intelligent image processing[C]. 2008 World Automation Congress.Newyork: IEEE, 2008:1-6.

[44] RACHMATULLAH M N, SUPRIANA I. Low resolution image fish classification using convolutional neural network[C]. 2018 5th International Conference on Advanced Informatics: Concept Theory and Applications (ICAICTA).Newyork: IEEE, 2018:78-83.

[45] ALLKEN V, HANDEGARD N O, ROSEN S, et al. Fish species identification using a convolutional neural network trained on synthetic data[J]. ICES Journal of Marine Science, 2019, 76(1):342-349.

[46] DE SILVA C W, WICKRAMARACHCHI N. An innovative machine for automated cutting of fish[J]. IEEE/ASME Transactions on Mechatronics, 1997, 2(2):86-98.

[47] GAMAGE L B, DE SILVA C W, GOSINE R G. Statistical pattern recognition for cutter positioning in automated fish processing[C]. Proceedings of IEEE Pacific Rim Conference on Communications Computers and Signal Processing.Newyork: IEEE, 1993:786-789.

[48] HYUN S H, LEE S C, KIM K H, et al. Shape, volume prediction modeling and identical weights cutting for frozen fishes[J]. Journal of Korean Institute of Intelligent Systems, 2012, 22(3):294-299.

[49] LEE M. A method for predicting the cutting points using random sample consensus partitioning technique and AI machine vision[J]. International Journal of Membrane Science and Technology, 2023, 10(4):183-191.

[50] XU J L, SUN D W. Computer vision detection of salmon muscle gaping using convolutional neural network features[J]. Food Analytical Methods, 2018, 11(1):34-47.

[51] BARBEDO J G A. A review on the use of computer vision and artificial intelligence for fish recognition, monitoring, and management: 6[J]. Fishes, 2022, 7(6): 335.

[52] BALABAN M O, UNAL SENGÖR G F, GIL SORIANO M, et al. Using image analysis to predict the weight of Alaskan salmon of different species[J]. Journal of Food Science, 2010, 75(3): E157-E162.

[53] FERNANDES A F A, TURRA E M, DE ALVARENGA É R, et al. Deep Learning image segmentation for extraction of fish body measurements and prediction of body weight and carcass traits in Nile Tilapia[J]. Computers and Electronics in Agriculture, 2020, 170:105274.

[54] SABERIOON M, ![]() P. Automated within tank fish mass estimation using infrared reflection system[J]. Computers and Electronics in Agriculture, 2018, 150:484-492.

P. Automated within tank fish mass estimation using infrared reflection system[J]. Computers and Electronics in Agriculture, 2018, 150:484-492.

[55] ZHANG L, WANG J P, DUAN Q L. Estimation for fish mass using image analysis and neural network[J]. Computers and Electronics in Agriculture, 2020, 173:105439.

[56] FREITAS J, VAZ-PIRES P, C MARA J S. Quality index method for fish quality control: Understanding the applications, the appointed limits and the upcoming trends[J]. Trends in Food Science &Technology, 2021, 111:333-345.

MARA J S. Quality index method for fish quality control: Understanding the applications, the appointed limits and the upcoming trends[J]. Trends in Food Science &Technology, 2021, 111:333-345.

[57] SAEED R, FENG H H, WANG X, et al. Fish quality evaluation by sensor and machine learning: A mechanistic review[J]. Food Control, 2022, 137:108902.

[58] SUN D W. Computer Vision Technology for Food Quality Evaluation[M]. 2nd edition. Amsterdam: Elsevier/Academic Press, 2016.

[59] TAPPI S, ROCCULI P, CIAMPA A, et al. Computer vision system (CVS): A powerful non-destructive technique for the assessment of red mullet (Mullus barbatus) freshness[J]. European Food Research and Technology, 2017, 243(12):2225-2233.

[60] ISSAC A, DUTTA M K, SARKAR B. Computer vision based method for quality and freshness check for fish from segmented gills[J]. Computers and Electronics in Agriculture, 2017, 139:10-21.

[61] SHI C, QIAN J P, HAN S, et al. Developing a machine vision system for simultaneous prediction of freshness indicators based on Tilapia (Oreochromis niloticus) pupil and gill color during storage at 4℃[J]. Food Chemistry, 2018, 243:134-140.

[62] HUANG X Y, XU H X, WU L, et al. A data fusion detection method for fish freshness based on computer vision and near-infrared spectroscopy[J]. Analytical Methods, 2016, 8(14):2929-2935.

[63] TAHERI-GARAVAND A, NASIRI A, BANAN A, et al. Smart deep learning-based approach for non-destructive freshness diagnosis of common carp fish[J]. Journal of Food Engineering, 2020, 278:109930.

[64] WU D, SUN D W. Advanced applications of hyperspectral imaging technology for food quality and safety analysis and assessment: A review: Part I: Fundamentals[J]. Innovative Food Science &Emerging Technologies, 2013, 19:1-14.

[65] WANG B, SUN J F, XIA L M, et al. The applications of hyperspectral imaging technology for agricultural products quality analysis: A review[J]. Food Reviews International, 2023, 39(2):1043-1062.

[66] CHENG J H, SUN D W, ZENG X N, et al. Non-destructive and rapid determination of TVB-N content for freshness evaluation of grass carp (Ctenopharyngodon idella) by hyperspectral imaging[J]. Innovative Food Science &Emerging Technologies, 2014, 21:179-187.

[67] WANG S N, DAS A K, PANG J, et al. Real-time monitoring the color changes of large yellow croaker (Larimichthys crocea) fillets based on hyperspectral imaging empowered with artificial intelligence[J]. Food Chemistry, 2022, 382:132343.

[68] KHOSHNOUDI-NIA S, MOOSAVI-NASAB M. Prediction of various freshness indicators in fish fillets by one multispectral imaging system[J]. Scientific Reports, 2019, 9(1):14704.

[69] MOOSAVI-NASAB M, KHOSHNOUDI-NIA S, AZIMIFAR Z, et al. Evaluation of the total volatile basic nitrogen (TVB-N) content in fish fillets using hyperspectral imaging coupled with deep learning neural network and meta-analysis[J]. Scientific Reports, 2021, 11(1):5094.

[70] DING R, HUANG X Y, HAN F K, et al. Rapid and nondestructive evaluation of fish freshness by near infrared reflectance spectroscopy combined with chemometrics analysis[J]. Analytical Methods, 2014, 6(24):9675-9683.

[71] PAULINE O, CHANG H T, TSAI I L, et al. Intelligent assessment of the histamine level in mackerel (Scomber australasicus) using near-infrared spectroscopy coupled with a hybrid variable selection strategy[J]. LWT, 2021, 145:111524.

[72] SIVERTSEN A H, KIMIYA T, HEIA K. Automatic freshness assessment of cod (Gadus morhua) fillets by Vis/Nir spectroscopy[J]. Journal of Food Engineering, 2011, 103(3):317-323.

[73] ZOTTE A D, OTTAVIAN M, CONCOLLATO A, et al. Authentication of raw and cooked freeze-dried rainbow trout (Oncorhynchus mykiss) by means of near infrared spectroscopy and data fusion[J]. Food Research International, 2014, 60:180-188.

[74] HUANG X Y, XIN J W, ZHAO J W. A novel technique for rapid evaluation of fish freshness using colorimetric sensor array[J]. Journal of Food Engineering, 2011, 105(4):632-637.

[75] MORSY M K, Z R K, KOSTESHA N, et al. Development and validation of a colorimetric sensor array for fish spoilage monitoring[J]. Food Control, 2016, 60:346-352.

R K, KOSTESHA N, et al. Development and validation of a colorimetric sensor array for fish spoilage monitoring[J]. Food Control, 2016, 60:346-352.

[76] DOM NGUEZ-ARAG

NGUEZ-ARAG N A, OLMEDO-MART

N A, OLMEDO-MART NEZ J A, ZARAGOZA-CONTRERAS E A. Colorimetric sensor based on a poly(ortho-phenylenediamine-co-aniline) copolymer for the monitoring of Tilapia (Orechromis niloticus) freshness[J]. Sensors and Actuators B: Chemical, 2018, 259:170-176.

NEZ J A, ZARAGOZA-CONTRERAS E A. Colorimetric sensor based on a poly(ortho-phenylenediamine-co-aniline) copolymer for the monitoring of Tilapia (Orechromis niloticus) freshness[J]. Sensors and Actuators B: Chemical, 2018, 259:170-176.

[77] GUO L L, WANG T, WU Z H, et al. Portable food-freshness prediction platform based on colorimetric barcode combinatorics and deep convolutional neural networks[J]. Advanced Materials, 2020, 32(45): 2004805.

[78] MA P H, JIA X X, XU W H, et al. Enhancing salmon freshness monitoring with Sol-gel cellulose nanocrystal colorimetric paper sensors and deep learning methods[J]. Food Bioscience, 2023, 56:103313.