随着我国食品工业持续扩张,食品安全与质量控制的重要性日益凸显[1]。传统的食品检测方法,如人工感官评价和化学分析,存在主观性强、效率低、破坏性大等问题,难以满足现代食品工业对高效、准确、非破坏性检测的需求[2]。近年来,国家高度重视食品安全检测技术的研发与应用,出台了一系列政策文件,如《“十四五”智能制造发展规划》和《推动工业领域设备更新实施方案》,明确提出加快发展智能检测装备,提升食品质量安全检测能力。

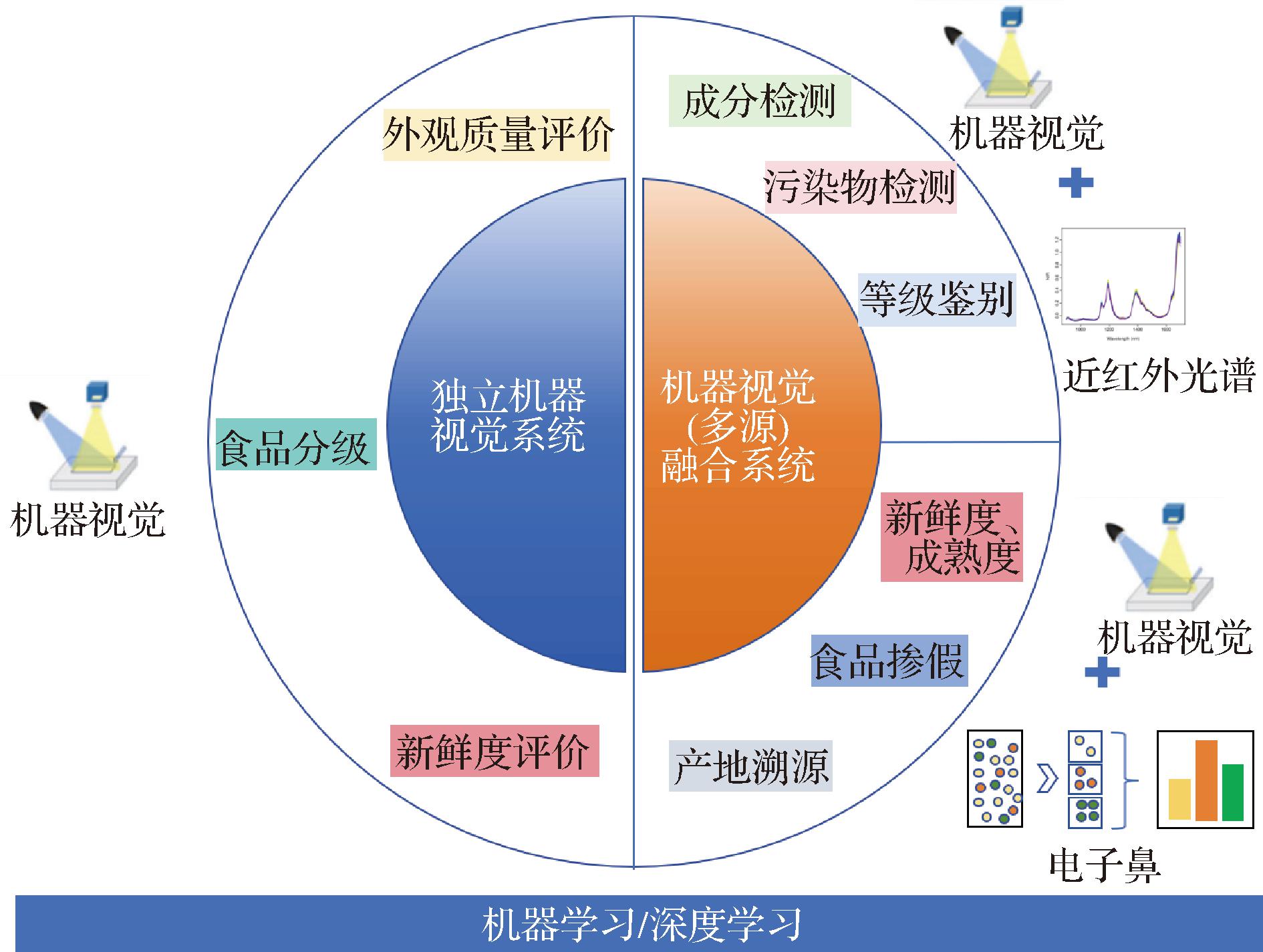

在此背景下,机器视觉(computer vision, CV)技术凭借非接触式检测、高通量处理及多维度量化等优势,成为智能检测的核心技术[3-4]。深度学习算法的引入,如卷积神经网络(convolutional neural network, CNN)[5]和残差网络(residual neural network, ResNet)[6],使得机器视觉系统在特征提取和分类方面的能力大幅提升,能够适应复杂多变的食品检测环境,提高系统的鲁棒性和泛化能力。此外,通过多模态数据融合技术,机器视觉提供的图像数据可以和其他无损检测技术如近红外光谱(near-infrared, NIR)[7]、电子鼻(electronic nose,E-nose)[8]提供的内部品质信息进行互补,从而提高无损检测的全面性和准确性。例如,在黑茶质量监测中,NIR和机器视觉通过深度学习模型融合后的准确率可以达到98.2%,对于大规模质量控制具有重要意义[9]。本文将系统介绍机器视觉在食品无损检测中的最新理论发展和应用进展,涵盖独立机器视觉和融合系统(图1),并探讨当前面临的挑战及未来的发展方向。通过对相关研究的综述,旨在为食品工业中机器视觉技术的应用提供参考和指导,助力我国食品工业的高质量发展。

图1 机器视觉技术在食品检测领域的应用

Fig.1 The application of CV in food detection

1 独立机器视觉系统

1.1 基本组成及原理

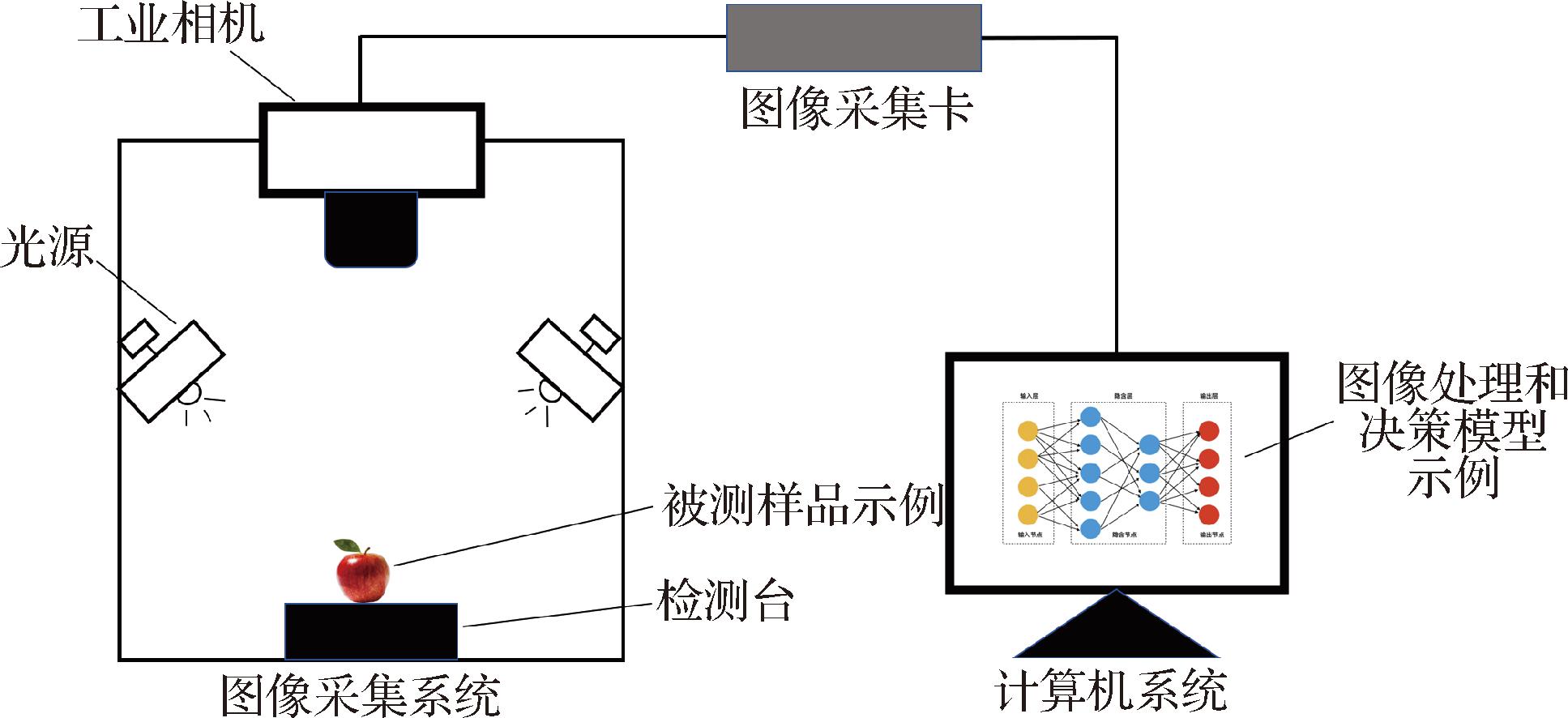

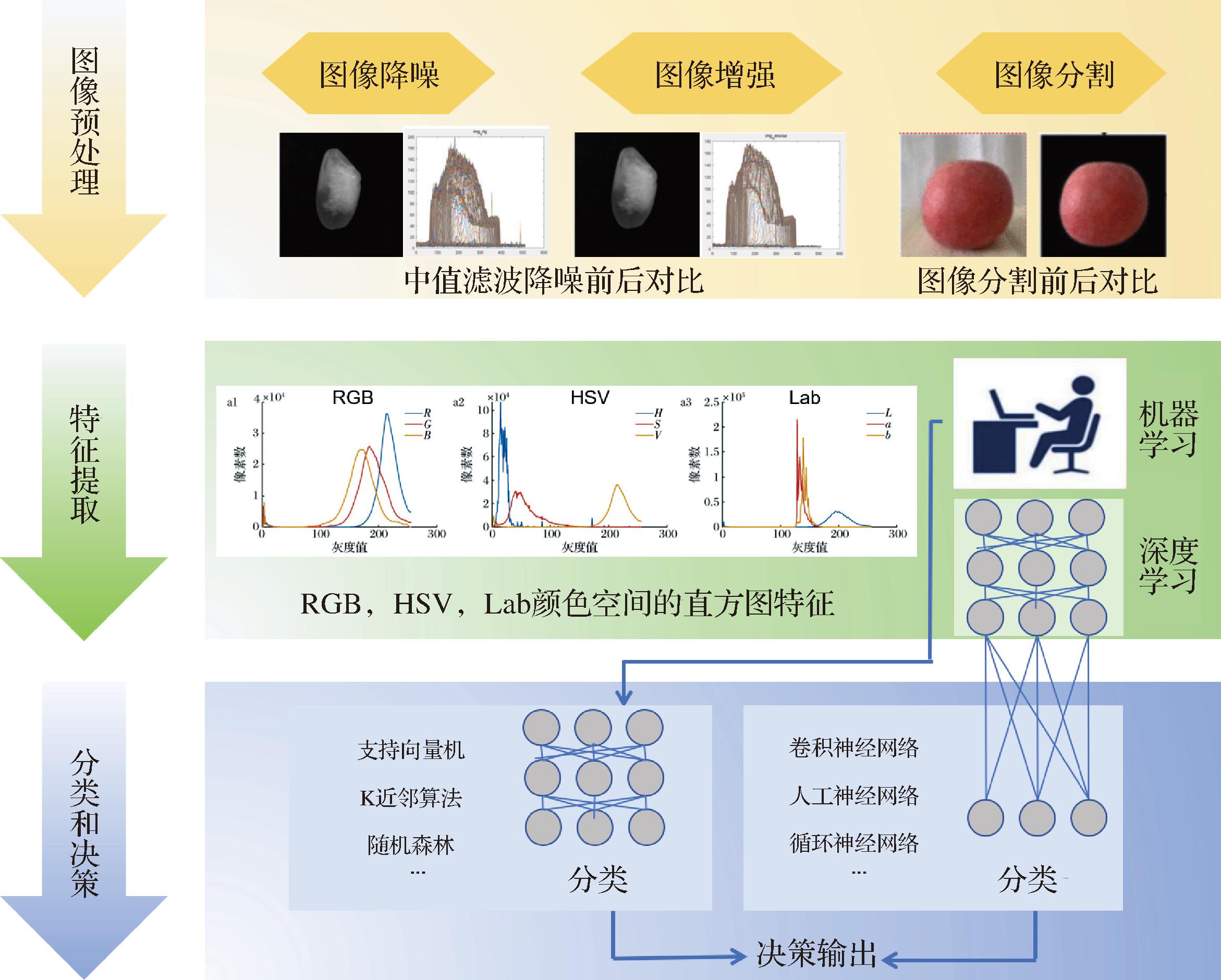

一个典型的机器视觉系统通常由成像单元(RGB可见光成像)、光源系统、图像处理模块和决策单元等核心模块组成(图2)[10]。它通过高分辨率工业相机采集图像,利用图像处理与模式识别算法提取食品颜色、形状、纹理等外观特征,并结合传统机器学习或深度学习模型进行判断和分类,从而实现食品品质的自动识别与评估(图3)[11]。

图2 独立机器视觉系统的架构

Fig.2 The architecture of computer vision system

图3 图像处理的方法和步骤

Fig.3 The methodology and procedure for image processing

1.2 数据处理方法

1.2.1 图像预处理

图像预处理的核心目的是提升图像质量与信息清晰度,为后续特征提取和建模奠定基础(图3)。由于食品图像常受到噪声、光照变化与背景干扰影响,预处理阶段通常采用高斯滤波、均值滤波、直方图均衡、自适应阈值分割与边缘检测等算法来去噪、增强对比度与实现目标区域的初步分割[12-15]。值得注意的是,深度学习在图像分割中已有初步的应用,在基于弱监督学习的CNN中,通常采用CNN模型来定位兴趣区域(region of interest, RoI),然后再与传统的非机器学习图像分割技术相结合。该方法充分利用了深度学习模型的语义理解能力,同时保持了传统分割方法的稳定性,取得了优异的图像分割效果[16-17]。

1.2.2 特征提取

特征提取阶段旨在从预处理后的图像中提取能反映食品外观差异的代表性特征,以提高模型的判别能力。典型特征包括颜色特征(如RGB直方图、HSV值)、纹理特征(如灰度共生矩阵、局部二值模式)以及几何形状特征(如面积、周长、Hu不变矩、长宽比等)[18-20]。例如,在水果分类中,色调、光泽与纹理粗糙度等特征能显著区分成熟度差异[21];在鱼体质量检测中,轮廓特征与表面纹理是识别病害的重要依据[22]。常用的特征提取算法包括传统图像处理方法、统计特征描述子、特征降维技术以及深度学习模型等。其中,最近研究表明,深度学习(如CNN)能够自动从原始数据中提取更加丰富和抽象的特征,避免了人工特征设计的局限性,提供了更高的精度和更强的泛化能力[23-24]。

1.2.3 分类和决策模型建立

分类建模的目的是依据提取的图像特征,构建具有判别能力的模型,实现对食品等级、品种、成熟度或病害状态的自动识别。传统机器学习方法如支持向量机(support vector machine, SVM)、K近邻算法(K-nearest neighbors, KNN)、随机森林(random forest, RF)等具有结构简单、训练高效的优点,广泛应用于分类任务中[25-26]。例如,TANGWANNAWIT等[27]在甜罗望子分级中应用RF模型,分类准确率达92%。近年来,深度学习模型如CNN、人工神经网络(artificial neural network, ANN)、循环神经网络(recurrent neural network, RNN)在图像识别任务中表现卓越,具备自动提取深层特征与端到端学习的能力[28]。反向传播神经网络(back propagation neural network, BPNN)是ANN的一种类型,其输入层负责接收原始数据或特征向量,其节点数等于输入特征的数量。因此,输入层的设计需要与数据的特征数量相匹配,以便正确地处理输入数据,确保一一对应的关系,适用于复杂数据集的处理。ZENG等[29]研究了RF、SVM、KNN和BPNN等分类模型在食品风味分类任务中的性能表现,研究显示BPNN模型在分类任务中表现最好,证明了人工神经网络在处理复杂数据集时具有显著的优势。

2 机器视觉和数据融合系统

在食品无损检测领域,数据融合技术日益广泛应用,旨在整合多源信息以提高检测准确性和鲁棒性。单一检测技术无法全面反映食品内外部质量特征,机器视觉能够提取丰富的外观信息,如颜色变化、纹理特征和形状尺寸,用于识别成熟度、腐败、畸形等问题,弥补光谱、电子鼻、X射线等无损检测方法在外观层面的不足。融合机器视觉与其他检测手段,已成为提升食品检测系统性能的重要途径。

2.1 基本组成和原理

一个典型的融合系统通常由两大核心模块组成:信息采集硬件系统以及数据融合与建模处理系统[30-32]。信息采集硬件系统负责同步采集来自多种传感器的数据,涵盖食品的外观和内部信息。数据融合与建模处理系统通过深度学习或机器学习算法整合这些多源数据,提取有效特征并构建分类模型,实现食品品质更加全面的自动识别与评估。

2.2 数据融合和建模方法

2.2.1 数据层融合

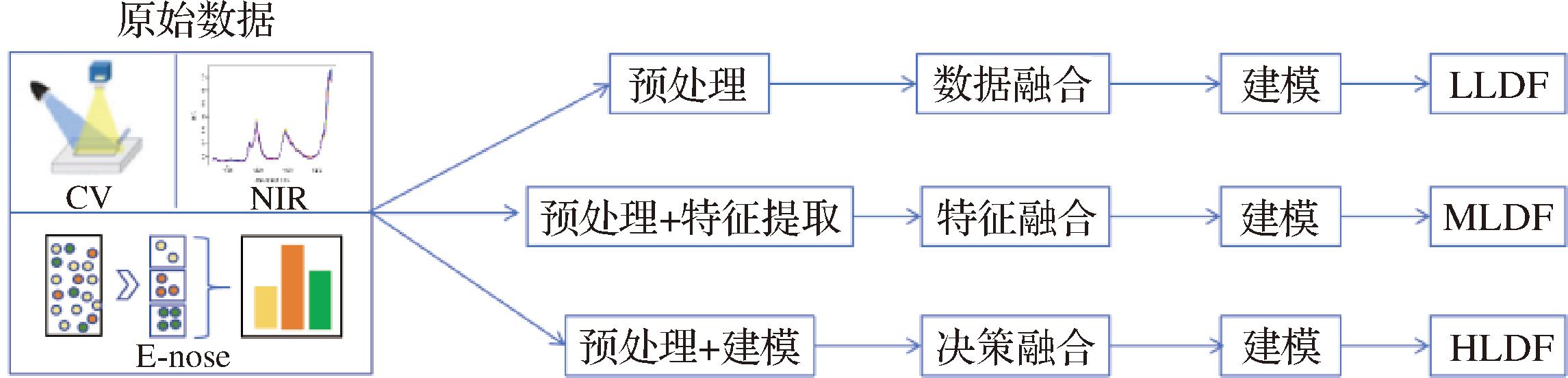

数据层融合又叫低层融合(low-level data fusion, LLDF),是指在原始数据层面对不同传感器的数据进行直接合并,如将图像像素矩阵与超声回波信号、NIR反射谱一同输入到模型。常见的处理工具包括直接归一化、导数处理等,以降低数据维度差异,减少噪声,提高建模稳定性[33-34]。WANG等[35]在运用微NIR、机器视觉以及色度传感阵列进行黑茶萎凋过程监测时,对三类数据源使用了低层融合策略,在使用主成分分析(principal component analysis, PCA)方法对原始数据降维后,利用SVM进行分类建模。结果显示,LLDF策略可实现90.0%的判别准确率,表现优于任一单一模态输入,但效果稍逊中层融合策略(97.5%准确率)。部分原因在于,低层融合的数据量巨大、计算复杂度高,且要求原始数据具有相似的数据形态,而视觉图像和其他模态数据(如光谱)数据形态差异较大,因此融合效果往往不佳。

2.2.2 特征层融合

特征层融合又叫中层融合(mid-level data fusion, MLDF),它是在各自数据源完成特征提取(如通过PCA、偏最小二乘回归、CNN提取深度特征)后,将特征向量进行拼接、映射或融合[33,36]。特征选择可以基于相关性分析(如Pearson相关分析)、因子分析、最大信息系数等技术[37]。张柏等[38]在提取红茶的光谱和图像数据特征时,主要通过PCA和Pearson相关分析对特征进行提取和筛选,并基于此构建了基于NIR、图像及其数据融合的判别模型。结果显示,单一NIR和图像数据的预测准确率分别为83.8%和73.5%,而MLDF模型的预测准确率显著提升至95.6%。MLDF兼顾信息量与模型效率,是机器视觉相关的多源数据融合领域应用最为广泛的融合方式。

2.2.3 决策层融合

决策层融合又叫高层融合(high-level data fusion, HLDF),指的是分别对各传感器建立独立预测模型,在完成各自判定后,通过决策规则(如多数投票、贝叶斯共识、德姆斯特-谢弗证据理论)进行综合决策[39]。在SRIVASTAVA等[40]进行水果质量评估的研究中,HLDF被用于融合来自电子鼻、超声波、光谱学和机器视觉等多源传感数据,每个数据源使用了不同的建模技术进行分析。这些技术的独立输出通过不同的决策规则(例如,基于贝叶斯共识的融合)进行综合,以进行综合决策。通过这种方法,研究人员能够为柑橘样本的成熟度、风味、糖分含量等参数提供更精确的预测。HLDF的优势是结构灵活,便于模块化管理,但依赖单一模型输出,信息利用程度较低。具体见图4。

图4 多源系统的数据融合和建模方法

Fig.4 The data fusion and modeling method for multi-source system

3 机器视觉在食品检测中的典型应用

3.1 独立机器视觉应用

独立机器视觉技术已得到广泛应用,且近年来,许多研究通过结合深度学习方法,显著提升了机器视觉系统的识别效率和精度[3]。其应用场景主要涵盖外观品质检测、食品分级、新鲜度评估等领域。

外观品质是影响消费者购买决策的重要因素。机器视觉能够快速采集食品表面的色泽、形状、尺寸、缺陷等信息,并进行自动分析与评估。贾磊等[41]设计了基于电荷耦合器件(charge-coupled device,CCD)相机和图像处理技术的水产食品外观品质检测系统,通过滤波与边缘检测实现水产品(如鱼、虾)色泽、大小和形状的准确检测,显著提升了检测效率和一致性。DA COSTA等[42]使用了基于深度学习的机器视觉方法,用于番茄外部缺陷的自动检测。研究构建了一个包含43 843张图像的大规模番茄缺陷数据集,并采用ResNet-50模型进行迁移学习训练,最佳模型在测试集上的平均精度为94.6%,召回率为86.6%。结果表明,微调策略优于传统特征提取方式,且模型能有效区分果实缺陷与茎、萼等非目标区域。FENG等[43]则进一步研究了不同深度网络学习模型的分类性能对比和轻量化模型研究。针对大西洋鲑鱼残留物检测问题,在YOLOv5n、YOLOv5s、YOLOv5m、YOLOv5l、YOLOv8n和Faster R-CNN等模型中,YOLOv5n模型分类准确性较好,在此基础上,作者开发了YOLOv5n-se模型,在保持模型轻量(仅3.75 MB)的同时,达到了0.865的平均精度(mAP50),有效解决了鱼鳞、鱼刺等反光干扰导致的漏检问题。

在食品加工中,不同等级产品需要进行准确分拣。基于机器视觉的分级系统可依据预设标准(如大小、颜色均匀度、完整性)自动分类食品样品。CENGEL等[16]研发出基于深度学习(GoogLeNet)的鸡蛋分拣系统,可以依据蛋壳表面缺陷和尺寸进行自动分类,分类准确率超过95%。GURURAJ等[44]开发了一种自动化芒果分级系统,结合CNN提取取芒果的成熟度、形状、纹理、颜色和缺陷等特征信息。提取的特征输入到随机森林分类器中,实现了芒果品种识别和质量分级,品种识别准确率达到93.2%,质量分级准确率达到95.1%。在实际应用中,除了准确率之外,图像处理速度对于大批量检测/在线检测场景非常关键。FAN等[45]开发了一种基于CNN的深度学习模型,用于在线识别苹果表面缺陷,并集成至四通道分选系统中,该系统能在每张图像处理时间低于72 ms的条件下进行高效分选,分类速度达到5个/s。同时,识别准确率达96.5%,召回率为100.0%。该模型的性能显著优于传统SVM分类方法,后者的准确率仅为87.1%。

随着研究的深入,机器视觉还被应用于检测食品的新鲜度与内部质量。JIA等[46]提出了一种基于机器视觉和眼部颜色参数(如RGB、Lab*、HSI等)来无损评估三文鱼在0 ℃贮藏条件下新鲜度的方法。通过将图像处理算法提取的眼部颜色特征与新鲜度指标相关联,构建了多元线性回归(multiple linear regression, MLR)和SVR模型,其中MLR模型在相关性、拟合精度和误差控制方面表现更优,相关系数R2为0.998 9~0.999 7,F值为186.26~589.42,显示该方法具备高准确性。TAHERI-GARAVAND等[47]使用机器视觉技术实时评估鸡肉在4 ℃下腐败过程中的新鲜度。系统包括图像采集、预处理、通道计算、特征提取及由遗传算法(genetic algorithm, GA)和ANN组成的特征选择与建模流程,最终构建的ANN模型达到相关系数0.99,均方误差仅为0.002,表现优异。

3.2 机器视觉和数据融合技术应用

近年来机器视觉与多种传感手段的融合研究不断推进。其中,机器视觉与NIR、E-nose、电子鼻的融合应用研究最为活跃,相关技术体系较为完善,实际应用案例也相对丰富,显示出较高的应用潜力。因此,本文重点围绕机器视觉与光谱融合及机器视觉与电子鼻融合的研究进展进行详细探讨。

3.2.1 机器视觉和NIR融合

NIR是一种基于物质对特定波长电磁辐射的吸收、反射、散射或透射特性来推断其内部成分的无损检测技术。具体而言,食品中的水分、脂肪、蛋白质和糖类等成分在近红外波段具有独特的吸收特性。通过分析食品在不同近红外波段下的光谱响应,可以快速、无损地获取其成分和品质信息[48-50]。机器视觉与光谱技术(如NIR)融合,能够综合捕捉样品的外观信息(如颜色、纹理、形状)和内部成分信息(如水分、蛋白质、糖分等化学成分),实现食品质量更全面、精准的无损检测,在品质成分检测、分级鉴别、污染物检测和食品掺假等方面有巨大的应用潜力,成为近几年的研究热点。

在品质成分检测方面,SUN等[51]认为样品颜色的变化会导致可见光/近红外(Vis/NIR)光谱发生失真,从而降低水果成分预测的准确性,并通过应用机器视觉和光谱融合技术实现橙子可溶性固形物含量的预测。该团队研究设计了集成图像与光谱数据采集装置,提出了基于颜色校正的一维卷积神经网络(1D-CNN)模型,与传统的1D-CNN模型相比,预测误差下降16.1%,表明多源融合能有效提升果蔬品质成分的预测准确性。LIU等[31]开发了一种结合NIR与机器视觉图像特征的茶叶水分含量无损检测方法。研究通过NIR捕捉样品内部水分变化,利用机器视觉提取颜色与纹理特征,并采用随机蛙跳算法与竞争性自适应重加权抽样算法筛选特征,最终融合模型结合SVR算法,在检测准确性与鲁棒性方面表现优异,预测性能为:![]() 类似的,WANG等[52]利用微型NIR仪与自构机器视觉系统,采集红茶在萎凋、揉捻、发酵和干燥各阶段的样品信息,通过中层特征融合策略,提取光谱与颜色变量,并建立偏最小二乘回归模型对茶多酚和儿茶素含量进行预测。研究发现,单一模态数据的低层融合效果有限,而中层融合模型预测精度最佳,其平均均方根方差分别为(0.66±0.12) g/100 g和(1.06±0.11) g/100 g。结果表明,融合光谱与图像的检测系统可有效提升预测性能,为红茶品质快速监测提供了可行方案。

类似的,WANG等[52]利用微型NIR仪与自构机器视觉系统,采集红茶在萎凋、揉捻、发酵和干燥各阶段的样品信息,通过中层特征融合策略,提取光谱与颜色变量,并建立偏最小二乘回归模型对茶多酚和儿茶素含量进行预测。研究发现,单一模态数据的低层融合效果有限,而中层融合模型预测精度最佳,其平均均方根方差分别为(0.66±0.12) g/100 g和(1.06±0.11) g/100 g。结果表明,融合光谱与图像的检测系统可有效提升预测性能,为红茶品质快速监测提供了可行方案。

在等级鉴别方面,研究主要关注茶叶的发酵程度、果蔬的成熟度和食品新鲜度等。ZHANG等[53]提出了一种基于中层特征融合的红茶发酵程度判别方法,融合便携式NIR仪和CCD相机获取的光谱与图像数据,并应用线性判别分析(linear discriminant analysis, LDA)、RF和SVM等分类模型进行建模。实验结果表明,通过逐步投影算法提取光谱特征与Pearson相关性分析提取图像变量构建的融合模型,在校准集和预测集上分别达到100.0%和95.0%的准确率。瓜果的成熟度一般可由可溶性固体含量和表面颜色判断。WANG等[54]利用可见-近红外技术在透射模式下获取甜瓜的光谱信息,分析其可溶性固体含量;同时利用机器视觉系统获取甜瓜破裂面的图像,结果显示多模式融合能更全面反映果实成熟度特征。HUANG等[55]采用相似的策略,开发了一种新型鱼类新鲜度数据融合检测方法。研究以罗非鱼为对象,提取图像和光谱信息并以可挥发性盐基氮(total volatile base nitrogen,TVB-N)为参考指标,使用BP-ANN构建预测模型,结果表明,CV单独使用时预测集准确率达90%,优于NIR光谱模型(80%),融合数据后准确率进一步提升至93.3%。该研究首次验证了CV与NIR融合方法在鱼类新鲜度判别中的优越性能。

针对污染物检测,ZHANG等[56]开发了一种融合技术的联用系统,用于在线快速筛查全麦样品中的脱氧雪腐镰刀菌烯醇(deoxynivalenol, DON)污染。通过在传送带上采集光谱和图像信息,并进行融合分析,研究采用判别分析方法以1 000 μg/kg 为分类阈值,在预测集中获得了93.5%的分类准确率,且融合特征相比单一特征显著降低了不确定性。尽管量化结果未达到理想标准,该方法在谷物及饲料加工过程中的快速污染筛查方面仍具有重要应用潜力。在食品掺假方面,SONG等[57]开发了一种快速识别方法,用于检测掺杂霉变稻米。该方法融合了逐步投影算法、PCA 和支持向量分类器,结合变量选择、特征提取与遗传算法优化参数,构建出多种识别模型。在测试集中,融合模型的准确率可以达到96.2%。

3.2.2 CV和E-nose

E-nose是一种模仿生物嗅觉系统的智能检测设备。其核心由气体传感器阵列组成,不同传感器对特定挥发性化合物有响应。当食品释放的气体与传感器接触时,传感器的电信号发生变化,经过信号处理和模式识别算法分析后,可实现对食品的品质、风味、新鲜度或污染状况的快速、无损、客观判断[58-60]。其和CV融合的系统能够同时采集食品的外观信息(如色彩、纹理、形状)和气味信息(如挥发性成分特征),从感官的角度实现食品品质状态的全面表征,下文从新鲜度、成熟度、掺假鉴别和产地溯源等领域分别进行研究案例分析。

在新鲜度检测方面,电子鼻通过采集食品的气味特征,和视觉图像信息互补,为新鲜度检测提供了新的思路。袁也等[61]对该想法进行验证,研究采用卷积神经网络-门控循环单元-注意力机制深度融合模型判定冷藏鱼肉的新鲜度,在特征融合基础上构建新鲜度分类器,三分类准确率达到97.6%,七分类准确率达到90.5%,融合方式显著优于单一传感器模式。徐海霞[62]针对菠菜采后品质变化,采取类似的策略,通过PCA与SVM方法提取并融合多模态特征,实现了菠菜新鲜度等级判别准确率达93.8%,叶绿素含量预测相关系数达到0.874。

在成熟度检测领域,王俊平等[63]结合CV提取的6个颜色特征与电子鼻采集的10个气味特征,采用最小二乘支持向量机构建融合模型,在番茄成熟度、硬度及红素含量的预测中均取得了优异效果。在食品加热过程中,通过判断食品由生变熟的时间可以实现食品加工的自动监控,但缺乏实现方式。FEDOROV等[64]利用E-nose来检测烤鸡过程中释放的挥发性气体与气溶胶浓度变化,识别不同加热阶段的气味特征;利用CV识别表面颜色变化,两者结合可实现鸡肉成熟状态的三阶段分类。实验结果表明,该融合方法具有良好的选择性与实用性,可为食品加热过程的自动监控提供有效手段。

在掺假鉴别领域,KIANI等[65]通过图像和气味特征提取,并结合PCA、SVM与多层感知神经网络模型,成功将掺假样本与正品藏红花区分开来,分类准确率分别达到100%。MIRHOSEINI-MOGHADDAM等[66]通过PCA提取的电子鼻数据和CV数据能有效地区分不同掺假的橄榄油样本,识别准确率达到100%。此外,使用MLR和响应曲线方法,研究发现该系统能准确地估计掺假百分比,并验证了E-nose与CV系统在快速、无损检测食品掺假的高效性和可靠性。

产地溯源是现代食品质量体系亟需解决的难题。CHEN等[67]通过结合CV与超快速气相电子鼻技术,实现了陈皮的产地溯源。该方法通过提取颜色、纹理和气味等特征,利用BPNN进行建模,在区分不同产地样本时取得了100%的判别准确率。研究表明,多源数据融合配合优化的E-nose算法,可为食品原产地溯源提供可靠依据与智能分析支持。ASADI等[68]构建了由CV系统和BPNN组成的数据融合系统,用于预测与红肉奇异果生长地区相关的质量特性。研究发现,该方法能够区分来自不同地区的奇异果样本,并提高了对Brix酸比和pH值预测的准确性。数据融合后的SVR模型在验证集上的R2值分别为90.2%和98.6%。

4 挑战和展望

在食品无损检测领域,单独依赖CV系统主要提取可见光下的表观特征(如颜色、纹理、形状等),虽然具有非接触、高效、自动化的优势,但仍存在局限。CV对食品内部成分变化(如水分、糖度、脂肪含量等)的感知能力有限,因此难以检测早期腐败或内部缺陷等问题。此外,成像质量易受光照、样品表面污染、拍摄角度等环境因素的影响,导致检测结果波动,降低了系统的稳定性和可重复性[69]。不同食品品种和生产批次的自然变异性也对传统模型的泛化能力提出了挑战,且现有食品视觉检测领域标准化数据集较少,限制了深度学习模型的训练效果和跨领域应用。

融合多源无损检测技术(如NIR、E-nose、超声波和X射线)虽能为食品检测提供更加全面的信息和判断依据,但也面临挑战。不同传感器输出的数据类型存在异质性,如何在不同模态间建立统一、高效的融合模型仍是难点[70]。同时,多模态系统增加了硬件复杂度和数据处理量,要求更高的同步性、协同设计及计算资源。现有的融合算法多在实验室环境下表现良好,但在复杂、动态的实际生产环境中的稳健性和泛化性能仍需验证。

未来,CV在食品无损检测中的应用将朝智能化、嵌入式和标准化方向发展。对于独立CV系统,研究需构建更大规模、更多样化的食品图像数据集,利用迁移学习、数据增强和生成对抗网络等手段提升模型的泛化能力。SONG等[71]曾于2024年提出一种泛化导向的度量学习框架,通过最大化类内距离与引入梯度自适应优化策略,有效提高了模型在未见类别与新领域上的表现。该方法在多个食品图像数据集(如 VIREO Food-172、ETHZ Food-101 和 ISIA Food-500)与通用数据集上均取得了显著性能提升,具有一定的迁移学习与模型训练策略上的借鉴意义。另外,轻量化深度学习模型的相关研究也吸引很多关注,其有效部署将有助于实现低成本、实时的检测应用。对于融合系统,应加强异构数据深度融合算法的研发,并推动融合检测技术从实验室向产业应用发展。通过结合物联网和云计算技术,实现食品质量的实时监测、异常预警和全流程追溯,助力食品产业智能化升级。

5 结语

CV作为食品无损检测的重要技术,具备快速、准确的优势,并具备非接触式获取食品外观、尺寸和颜色等信息的能力,显著提升了质量控制效率。随着图像处理与深度学习的发展,其在特征提取与环境适应性方面不断优化,应用领域持续拓展。本文梳理了CV视觉系统组成与算法,介绍了其与NIR等无损检测技术的融合策略,并总结了其在食品品质检测、分级分类、掺假识别等方面的研究进展。同时,分析了当前在数据获取、模型泛化和系统集成方面的挑战,并展望了轻量化部署和多模态融合的发展方向。总体而言,CV正为食品工业智能化、数字化转型提供有力支持,未来将在保障食品安全与质量控制中发挥更大作用,促进《中华人民共和国食品安全法》等法规的高效执行和落地。

[1] LI C J, ZHU H M, LI C Y, et al.The present situation of pesticide residues in China and their removal and transformation during food processing[J].Food Chemistry, 2021, 354:129552.

[2] HUSSAIN N, SUN D W, PU H B.Classical and emerging non-destructive technologies for safety and quality evaluation of cereals:A review of recent applications[J].Trends in Food Science &Technology, 2019, 91:598-608.

[3] KAUSHAL S, TAMMINENI D K, RANA P, et al.Computer vision and deep learning-based approaches for detection of food nutrients/nutrition:New insights and advances[J].Trends in Food Science &Technology, 2024, 146:104408.

[4] 叶东东, 徐霞, 丁玉庭.深度学习与机器视觉在鱼类加工与品质监测中的研究进展[J].食品与发酵工业, 2024, 50(22):389-398.

YE D D, XU X, DING Y T.Research progress on deep learning and machine vision for fish processing and quality monitoring[J].Food and Fermentation Industries,2024,50(22):389-398.

[5] 祝诗平,卓佳鑫,黄华,等.基于 CNN 的小麦籽粒完整性图像检测系统[J].农业机械学报,2020, 51(5):36-42.ZHU S P, ZHUO J X, HUANG H, et al.Wheat grain integrity image detection system based on CNN[J].Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(5):36-42.

[6] SONG W R, WANG H, YUN Y H.Smartphone video imaging:A versatile, low-cost technology for food authentication[J].Food Chemistry, 2025, 462:140911.

[7] SONG Y, WANG X Z, XIE H L, et al.Quality evaluation of Keemun black tea by fusing data obtained from near-infrared reflectance spectroscopy and computer vision sensors[J].Spectrochimica Acta Part A:Molecular and Biomolecular Spectroscopy, 2021, 252:119522.

[8] 邓明磊, 李静, 包凯铖, 等.基于机器视觉及电子鼻的天麻微波热风干燥品质预测[J].食品与发酵工业, 2025,51(21):392-399.DENG M L, LI J, BAO K C, et al.Prediction of Gastrodia elata drying quality based on machine vision and electronic nose technology[J].Food and Fermentation Industries, 2025,51(21):392-399.

[9] LIANG J H, GUO J M, XIA H L, et al.A black tea quality testing method for scale production using CV and NIRS with TCN for spectral feature extraction[J].Food Chemistry, 2025, 464:141567.

[10] LOU Y S.Research on the embedded machine vision in information acquisition and processing analysis[J].Journal of Physics:Conference Series, 2021, 1992(2):022130.

[11] DHIMAN P, KAUR A, BALASARASWATHI V R, et al.Image acquisition, preprocessing and classification of citrus fruit diseases:a systematic literature review[J].Sustainability, 2023, 15(12):9643.

[12] KORESH H J D.Implementation and efficient analysis of preprocessing techniques in deep learning for image classification[J].Current Medical Imaging, 2024, 20:e290823220482.

[13] GUO Y, GAO Y H, HU B L, et al.CMID:Crossmodal image denoising via pixel-wise deep reinforcement learning[J].Sensors, 2023, 24(1):42.

[14] QI Y L, YANG Z, SUN W H, et al.A comprehensive overview of image enhancement techniques[J].Archives of Computational Methods in Engineering, 2022, 29(1):583-607.

[15] CHEN Y, FENG K, LU J J, et al.Machine vision on the positioning accuracy evaluation of poultry viscera in the automatic evisceration robot system[J].International Journal of Food Properties, 2021, 24(1):933-943.

[16] CENGEL T A, GENCTURK B, YASIN E T, et al.Automating egg damage detection for improved quality control in the food industry using deep learning[J].Journal of Food Science, 2025, Volume 90(1):e17553.

[17] ROY K, CHAUDHURI S S, PRAMANIK S.Deep learning based real-time industrial framework for rotten and fresh fruit detection using semantic segmentation[J].Microsystem Technologies, 2021, 27(9):3365-3375.

[18] 霍志林, 吴洪潭, 华享, 等.灰度共生矩阵在蔬菜种类识别中的应用研究[J].中国计量学院学报, 2015, 26(1):105-109.HUO Z L, WU H T, HUA X, et al.Application of gray level co-occurrence matrix in vegetable species recognition[J].Journal of China University of Metrology, 2015, 26(1):105-109.

[19] 陈斌, 饶洪辉, 刘木华.基于傅里叶描述子和Hu不变矩的油茶果识别[J].浙江农业科学, 2020, 61(9):1876-1880.CHEN B, RAO H H, LIU M H.Recognition of camellia fruit based on Fourier descriptor and Hu invariant moments[J].Zhejiang Agricultural Sciences, 2020, 61(9):1876-1880.

[20] 闵巍庆, 刘林虎, 刘宇昕, 等.食品图像识别方法综述[J].计算机学报, 2022, 45(3):542-566.MIN W Q, LIU L H, LIU Y X, et al.A survey on food image recognition[J].Chinese Journal of Computers, 2022, 45(3):542-566.

[21] RIZZO M, MARCUZZO M, ZANGARI A, et al.Fruit ripeness classification:A survey[J].Artificial Intelligence in Agriculture, 2023, 7:44-57.

[22] DOWLATI M, DE LA GUARDIA M, DOWLATI M, et al.Application of machine-vision techniques to fish-quality assessment[J].TrAC Trends in Analytical Chemistry, 2012, 40:168-179.

[23] LIU Y, PU H B, SUN D W.Efficient extraction of deep image features using convolutional neural network (CNN) for applications in detecting and analysing complex food matrices[J].Trends in Food Science &Technology, 2021, 113:193-204.

[24] TAHERI-GARAVAND A, NASIRI A, BANAN A, et al.Smart deep learning-based approach for non-destructive freshness diagnosis of common carp fish[J].Journal of Food Engineering, 2020, 278:109930.

[25] MANDAL D, CHATTERJEE A, TUDU B.A color channel based on multiple Random Forest coupled with a computer vision technique for the detection and prediction of Sudan dye-I adulteration in turmeric powder[J].Color Research &Application, 2022, 47(2):388-400.

[26] SHEN D L, ZHANG S F, MING W Y, et al.Development of a new machine vision algorithm to estimate potato’s shape and size based on support vector machine[J].Journal of Food Process Engineering, 2022, 45(3):e13974.

[27] TANGWANNAWIT P, TANGWANNAWIT S.Feature extraction to predict quality of segregating sweet tamarind using image processing[J].Indonesian Journal of Electrical Engineering and Computer Science, 2022, 25(1):339.

[28] SYED-AB-RAHMAN S F, HESAMIAN M H, PRASAD M.Citrus disease detection and classification using end-to-end anchor-based deep learning model[J].Applied Intelligence, 2022, 52 (1):927-938.

[29] ZENG X Q, CAO R, XI Y, et al.Food flavor analysis 4.0:A cross-domain application of machine learning[J].Trends in Food Science &Technology, 2023, 138:116-125.

[30] 王晨阳. 基于电子鼻和图像数据融合的鸡肉新鲜度无损检测研究[D].南京:南京农业大学, 2022.WANG C Y.Research on non-destructive detection of chicken freshness based on electronic nose and image data fusion[D].Nanjing: Nanjing Agricultural University, 2022.

[31] LIU Z Y, ZHANG R T, YANG C S, et al.Research on moisture content detection method during green tea processing based on machine vision and near-infrared spectroscopy technology[J].Spectrochimica Acta Part A:Molecular and Biomolecular Spectroscopy, 2022, 271:120921.

[32] WANG X Q, CUI W W, GUO W T, et al.Separation techniques for manufacturing fruit spirits:From traditional distillation to advanced pervaporation process[J].Comprehensive Reviews in Food Science and Food Safety, 2024, 23(1):e13278.

[33] AZCARATE S M, R OS-REINA R, AMIGO J M, et al.Data handling in data fusion:Methodologies and applications[J].TrAC Trends in Analytical Chemistry, 2021, 143:116355.

OS-REINA R, AMIGO J M, et al.Data handling in data fusion:Methodologies and applications[J].TrAC Trends in Analytical Chemistry, 2021, 143:116355.

[34] DI ROSA A R, LEONE F, CHELI F, et al.Fusion of electronic nose, electronic tongue and computer vision for animal source food authentication and quality assessment—A review[J].Journal of Food Engineering, 2017, 210:62-75.

[35] WANG Y, LIU Y, CUI Q, et al.Monitoring the withering condition of leaves during black tea processing via the fusion of electronic eye (E-eye), colorimetric sensing array (CSA), and micro-near-infrared spectroscopy (NIRS)[J].Journal of Food Engineering, 2021, 300:110534.

[36] STRANI L, DURANTE C, COCCHI M, et al.Data fusion strategies for the integration of diverse non-destructive spectral sensors (NDSS) in food analysis[J].TrAC Trends in Analytical Chemistry, 2024, 180:117957.

[37] BORR S E, FERRÉ J, BOQUÉ R, et al.Data fusion methodologies for food and beverage authentication and quality assessment-A review[J].Analytica Chimica Acta, 2015, 891:1-14.

S E, FERRÉ J, BOQUÉ R, et al.Data fusion methodologies for food and beverage authentication and quality assessment-A review[J].Analytica Chimica Acta, 2015, 891:1-14.

[38] 张柏,凌彩金,李露青,等.基于数据融合策略的红茶发酵程度判别[J].农业工程学报,2022,38(15):339-347.ZHANG B, LING C J, LI L Q, et al.Discrimination of black tea fermentation degrees based on data fusion strategy[J].Transactions of the Chinese Society of Agricultural Engineering, 2022, 38(15):339-347.

[39] LI B, SUN J, LIU Y, et al.Multi-level data fusion strategy based on spectral and image information for identifying varieties of soybean seeds[J].Spectrochimica Acta Part A:Molecular and Biomolecular Spectroscopy, 2024, 322:124815.

[40] SRIVASTAVA S, SADISTAP S.Data fusion for fruit quality authentication:Combining non-destructive sensing techniques to predict quality parameters of citrus cultivars[J].Journal of Food Measurement and Characterization, 2022, 16(1):344-365.

[41] 贾磊, 陈俊超.机器视觉的水产食品外观品质检测系统[J].食品工业, 2021, 42(5):266-268.JIA L, CHEN J C.Machine vision inspection system for appearance quality of aquatic food[J].The Food Industry, 2021, 42(5):266-268.

[42] DA COSTA A Z, FIGUEROA H E H, FRACAROLLI J A.Computer vision based detection of external defects on tomatoes using deep learning[J].Biosystems Engineering, 2020, 190:131-144.

[43] FENG Y, LI X X, ZHANG Y G, et al.Detection of Atlantic salmon residues based on computer vision[J].Journal of Food Engineering, 2023, 358:111658.

[44] GURURAJ N, VINOD V, VIJAYAKUMAR K.Deep grading of mangoes using convolutional neural network and computer vision[J].Multimedia Tools and Applications, 2023, 82(25):39525-39550.

[45] FAN S X, LI J B, ZHANG Y H, et al.On-line detection of defective apples using computer vision system combined with deep learning methods[J].Journal of Food Engineering, 2020, 286:110102.

[46] JIA Z X, LI M, SHI C, et al.Determination of salmon freshness by computer vision based on eye color[J].Food Packaging and Shelf Life, 2022, 34:100984.

[47] TAHERI-GARAVAND A, FATAHI S, SHAHBAZI F, et al.A nondestructive intelligent approach to real-time evaluation of chicken meat freshness based on computer vision technique[J].Journal of Food Process Engineering, 2019, 42(4):e13039.

[48] 吴浩, 刘源, 董若琰, 等.近红外光谱分析技术在动物源性食品检测中的应用进展[J].食品工业科技, 2013, 34(5):392-395.

WU H, LIU Y, DONG R Y, et al.Progress in animal foods detection by near infrared spectroscopy analytical technique[J].Science &Technology of Food Industry, 2013, 34(5):392-395.

[49] CORTÉS V, BLASCO J, ALEIXOS N, et al.Monitoring strategies for quality control of agricultural products using visible and near-infrared spectroscopy:A review[J].Trends in Food Science &Technology, 2019, 85:138-148.

[50] ![]() K B, GRABSKA J, HUCK C W.Principles and applications of miniaturized near-infrared (NIR) spectrometers[J].Chemistry-A European Journal, 2021, 27(5):1514-1532.

K B, GRABSKA J, HUCK C W.Principles and applications of miniaturized near-infrared (NIR) spectrometers[J].Chemistry-A European Journal, 2021, 27(5):1514-1532.

[51] SUN Z Z, TIAN H, HU D, et al.Integrating deep learning and data fusion for enhanced oranges soluble solids content prediction using machine vision and Vis/NIR spectroscopy[J].Food Chemistry, 2025, 464:141488.

[52] WANG Y J, LI L Q, LIU Y, et al.Enhanced quality monitoring during black tea processing by the fusion of NIRS and computer vision[J].Journal of Food Engineering, 2021, 304:110599.

[53] ZHANG B, LI Z F, SONG F H, et al.Discrimination of black tea fermentation degree based on multi-data fusion of near-infrared spectroscopy and machine vision[J].Journal of Food Measurement and Characterization, 2023, 17(4):4149-4160.

[54] WANG A C, FU X P, XIE L J.Application of visible/near-infrared spectroscopy combined with machine vision technique to evaluate the ripeness of melons (Cucumis melo L.)[J].Food Analytical Methods, 2015, 8(6):1403-1412.

[55] HUANG X Y, XU H X, WU L, et al.A data fusion detection method for fish freshness based on computer vision and near-infrared spectroscopy[J].Analytical Methods, 2016, 8(14):2929-2935.

[56] ZHANG B, JIANG X S, SHEN F, et al.Rapid screening of DON contamination in whole wheat meals by Vis/NIR spectroscopy and computer vision coupling technology[J].International Journal of Food Science &Technology, 2021, 56(6):2588-2595.

[57] SONG C X, LIU J M, WANG C Q, et al.Rapid identification of adulterated rice based on data fusion of near-infrared spectroscopy and machine vision[J].Journal of Food Measurement and Characterization, 2024, 18(5):3881-3892.

[58] MOHD ALI M, HASHIM N, ABD AZIZ S, et al.Principles and recent advances in electronic nose for quality inspection of agricultural and food products[J].Trends in Food Science &Technology, 2020, 99:1-10.

[59] PERIS M, ESCUDER-GILABERT L.Electronic noses and tongues to assess food authenticity and adulteration[J].Trends in Food Science &Technology, 2016, 58:40-54.

[60] LU L, HU Z Q, HU X Q, et al.Electronic tongue and electronic nose for food quality and safety[J].Food Research International, 2022, 162(B):112214.

[61] 袁也, 周博, 吴泽玮.基于电子鼻和机器视觉的鱼肉新鲜度检测研究[J].食品与发酵工业, 2024, 50(24):313-320.YUAN Y, ZHOU B, WU Z W.Fish freshness detection based on an electronic nose and machine vision[J].Food and Fermentation Industries, 2024, 50(24):313-320.

[62] 徐海霞. 基于机器视觉和电子鼻技术的菠菜新鲜度无损检测研究[D].江苏大学, 2016.XU H X.Research on non-destructive detection of spinach freshness based on machine vision and electronic nose technology[D].Jiangsu University, 2016.

[63] 王俊平, 徐刚.机器视觉和电子鼻融合的番茄成熟度检测方法[J].食品与机械, 2022, 38(2):148-152.WANG J P, XU G.Research on tomato maturity detection method based on machine vision and electronic nose fusion[J].Food &Machinery, 2022, 38(2):148-152.

[64] FEDOROV F S, YAQIN A, KRASNIKOV D V, et al.Detecting cooking state of grilled chicken by electronic nose and computer vision techniques[J].Food Chemistry, 2021, 345:128747.

[65] KIANI S, MINAEI S, GHASEMI-VARNAMKHASTI M.Integration of computer vision and electronic nose as non-destructive systems for saffron adulteration detection[J].Computers and Electronics in Agriculture, 2017, 141:46-53.

[66] MIRHOSEINI-MOGHADDAM S M, YAMAGHANI M R, BAKHSHIPOUR A.Application of electronic nose and eye systems for detection of adulteration in olive oil based on chemometrics and optimization approaches[J].JUCS-Journal of Universal Computer Science, 2023, 29(4):300-325.

[67] CHEN P, FU R, SHI Y B, et al.Optimizing BP neural network algorithm for Pericarpium Citri Reticulatae (Chenpi) origin traceability based on computer vision and ultra-fast gas-phase electronic nose data fusion[J].Food Chemistry, 2024, 442:138408.

[68] ASADI M, GHASEMNEZHAD M, BAKHSHIPOUR A, et al.Predicting the quality attributes related to geographical growing regions in red-fleshed kiwifruit by data fusion of electronic nose and computer vision systems[J].BMC Plant Biology, 2024, 24(1):13.

[69] BERGSTROM A.Understanding image quality for deep learning-based computer vision[D].Rochester:Rochester Institute of Technology, 2023.

[70] GUO M Q, WANG K Q, LIN H, et al.Spectral data fusion in nondestructive detection of food products:Strategies, recent applications, and future perspectives[J].Comprehensive Reviews in Food Science and Food Safety, 2024, 23(1):e13301.

[71] SONG J J, LI Z, MIN W Q, et al.Towards food image retrieval via generalization-oriented sampling and loss function design[J].ACM Transactions on Multimedia Computing, Communications and Applications, 2023, 20(1):1-19.